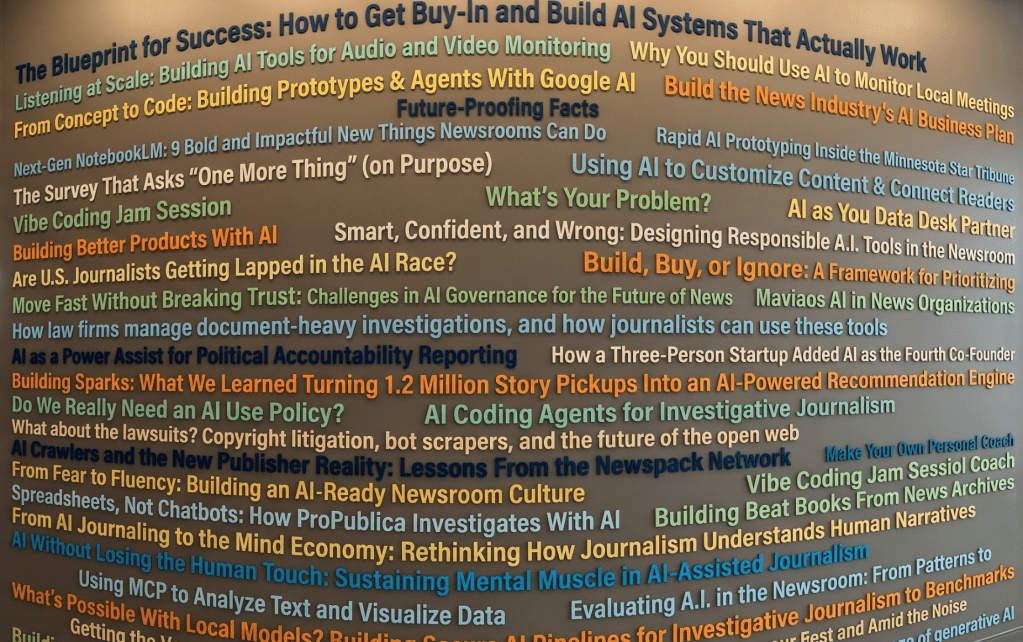

Tapahtuman sessioiden nimiä (kuvitus: Gemini). Olen jäsentänyt 41 sessiota tässä kirjoituksessa seitsemän teeman alle lukemisen helpottamiseksi.

Kolme ihmistä rakentaa journalistista organisaatiota, jolla on heidän lisäkseen kolme nimettyä Claude-agenttia “co-founderina” — kukin omalla roolillaan ja vastuualueellaan (Ryan, Justin, Liz).

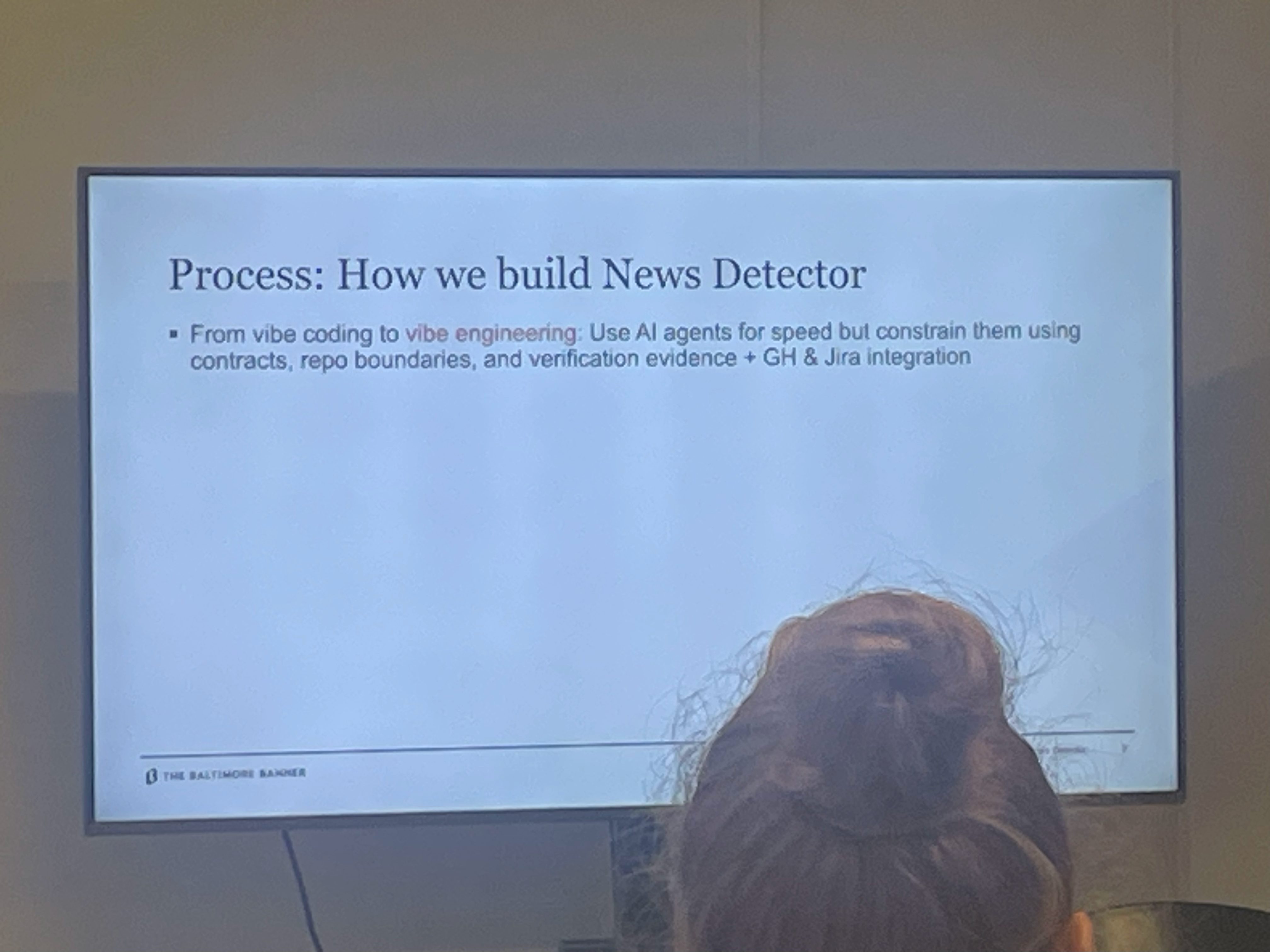

Lehti, joka kehitti kolmessa kuukaudessa yli sataa lähdettä automaattisesti seuraavan työkalun toimittajille: RSS-syötteistä somen kautta erilaisiin hallinnon asiakirjoihin. Filosofia työkalun taustalla on “vibe engineering”.

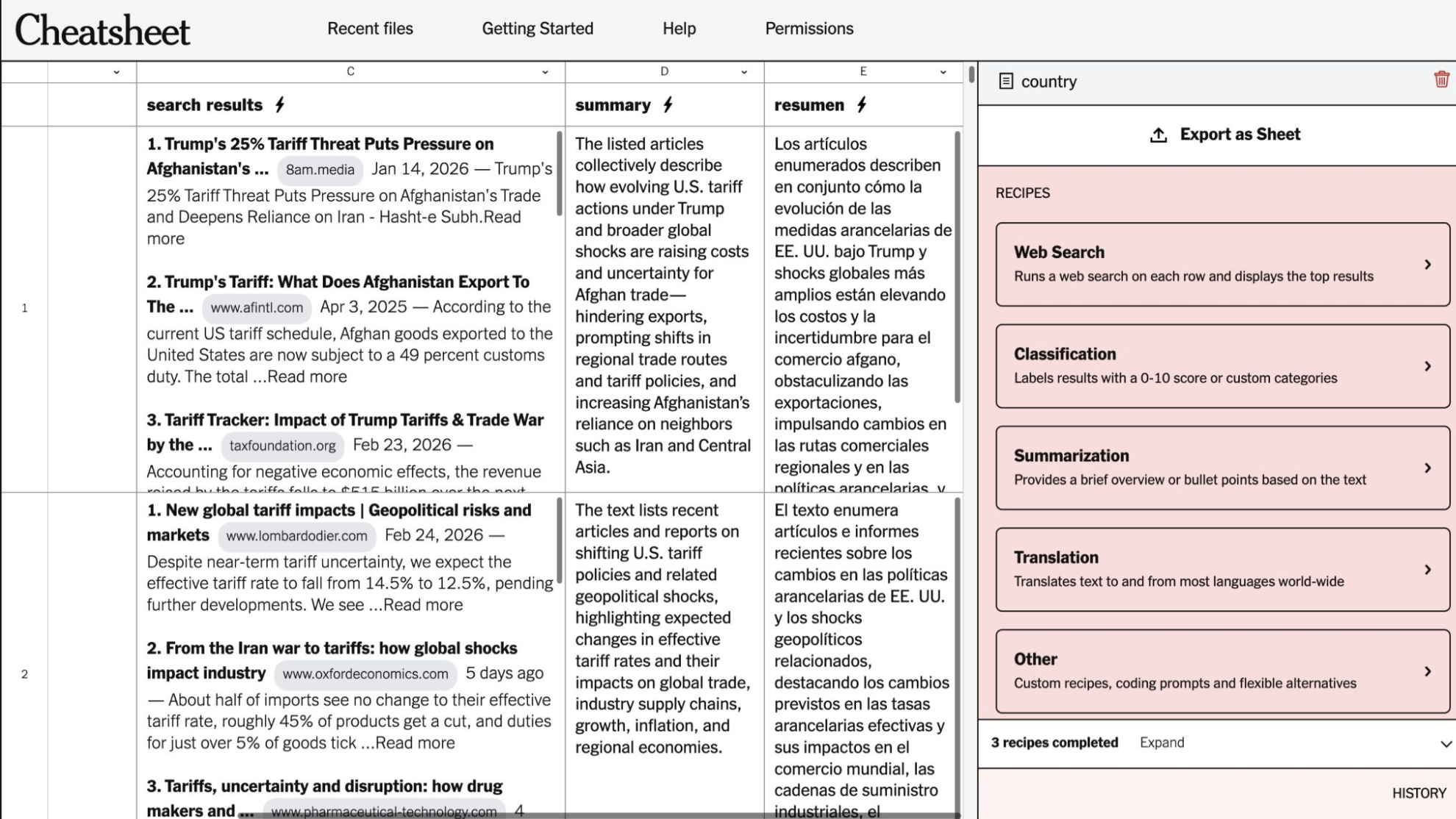

Poliisiradion kaikki keskustelut kulkevat Raspberry Pi -tietokoneen kautta ja systeemi hälyttää Slackiin, jos jotain uutisarvoista tapahtuu.

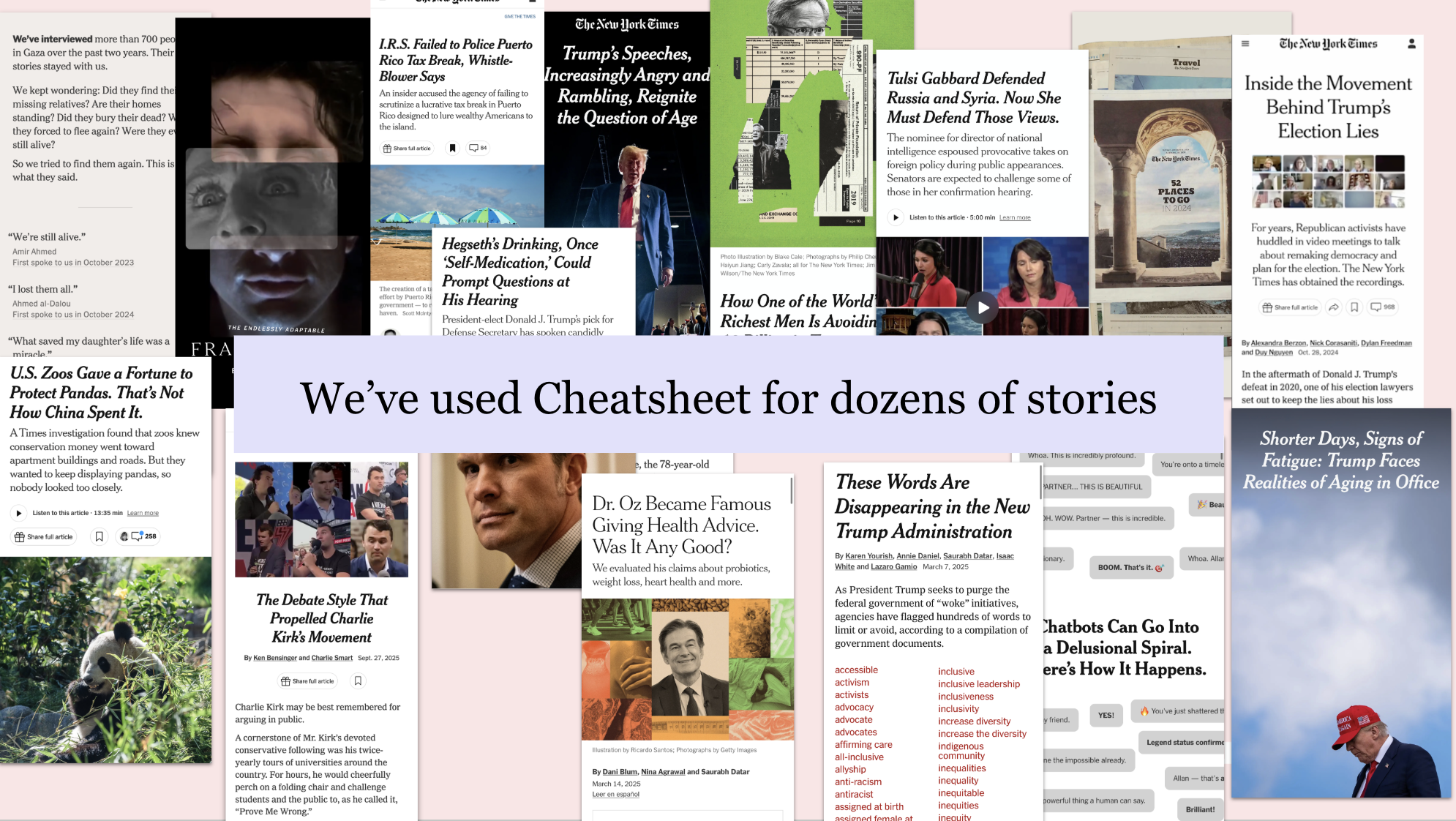

Voittoa tavoittelemattoman organisaation tutkivat toimittajat löysivät parhaan tekoälytyökalunsa, ja se ei ole tekoälychat, vaan Google Sheets.

Milloin rakentaa tekoälytyökalu itse, milloin ostaa se ulkoa ja milloin olla tekemättä mitään? Tähän löytyy useampikin malli uutismediasta.

Muun muassa nämä esimerkit tulivat vastaan kahden päivän aikana Hacks and Hackers AI × Journalism Summit -tapahtumassa Baltimoressa 13.-14. toukokuuta 2026.

Tapahtuman anti oli sen verran konkreettinen, että päätin purkaa kaikki yli 40 sessiota lyhyesti tähän kirjoitukseen. Ne joissa olin itse mukana tekemässä muistiinpanoja, olen avannut laajemmin. Otsikkoteemoitus on minun, jotta kokonaisuutta olisi helpompi hahmottaa.

Tapahtumaan kokoontui kaikkiaan kolmesataa journalistia, kehittäjää ja median ammattilaista.

TEEMA 1: Milloin ostaa, milloin tehdä itse ja milloin luopua koko ideasta?

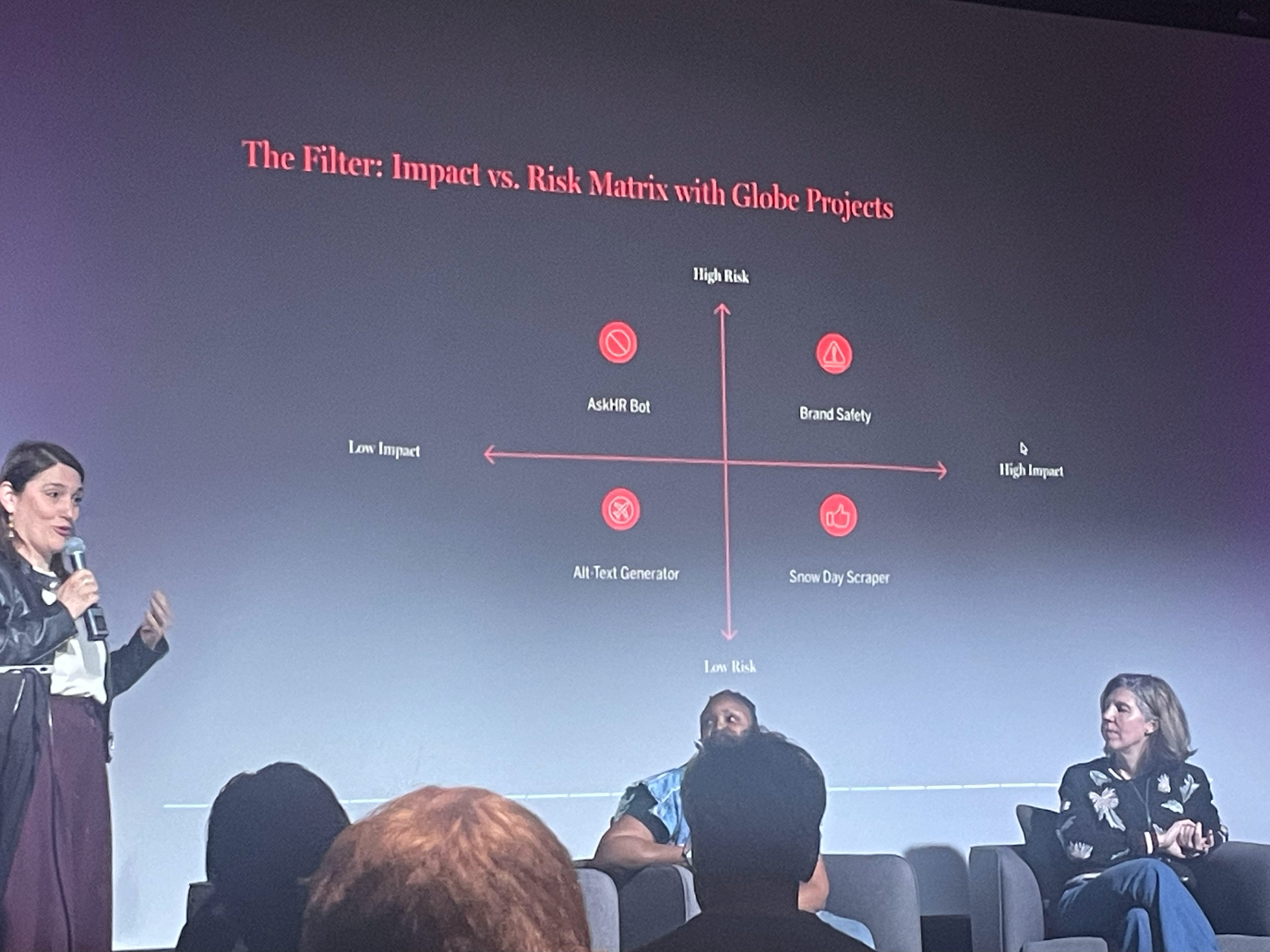

SESSIO: Build, Buy, or Ignore: A Framework for Prioritizing AI in News Organizations

Shira Center (Boston Globe Media), Aimee Rinehart (Frontier Collective), Chase Davis (Local Angle), Paris Brown (Baltimore Times)

”Voisiko AI auttaa tässä?”. Jokainen on kuullut tämän kysymyksen organisaatiossaan. Session pointti oli, että kaikille ei voi vastata kyllä, eikä pidäkään. Sessio tarjosi mm. kolmivaiheisen mallin, jonka avulla uutisorganisaatio voi päättää, kannattaako jokin AI-hanke toteuttaa itse, ostaa valmiina tuotteena vai jättää kokonaan väliin. Mallin kolme vaihetta ovat Impact (edistääkö se tavoitteitasi), Risk (miten huonosti käy jos kaikki menisi pieleen) ja Commonality (ovatko muutkin tässä samassa tilanteessa). Hyvä esimerkki medioiden haasteista käytännössä: Boston Globe rakensi 2023 itse Slack-botin otsikkoehdotuksia varten, 2024 markkinoille tuli valmistuotteita jotka tekivät saman asian, ja 2025 Globen julkaisujärjestelmän sisälsi kaikki samat ominaisuudet valmiina.

Omat muistiinpanoni yo. sessioon:

Konkreettisin esimerkki tuli Baltimoresta: piskuinen kolmen hengen paikallislehti rakensi AI-työkalun, joka auttaa toimittajaa etsimään uutisaiheita ja tuottaa artikkeliluonnoksen suoraan julkaisujärjestelmään. Koko työkalu maksoi alle 2 000 dollaria ja ostettiin ulkoiselta kumppanilta, koska se oli käytännössä ainoa vaihtoehto. Kaikki meni hyvin. Panelisti Paris Brownin vinkki oli hyvä: “Testaa jokainen työkalu sillä metodilla, että mikä on pahinta mitä voi tapahtua, jos kaikki menee pieleen. Useimmiten ei kovinkaan pahaa.”

SESSIO: Building Better Products With AI

Aldana Vales (CUNY), Scott Klein, Julia Moak (Greenpointers), Kalle Pirhonen

Olin itse mukana tässä paneelissa osana AI Builders -kurssini lopputyötä sivuavaa keskustelua. Sessio käsitteli sitä, miten tekoälyä voidaan käyttää tuotteiden rakentamiseen tavalla, joka on aidosti hyödyllinen, luotettava ja yleisöjen tarpeisiin vastaava.

SESSIO: Smart, Confident, and Wrong: Designing Responsible A.I. Tools in the Newsroom

Dylan Freedman & James O’Toole (The New York Times)

New York Timesin tuotekehitystiimi purki ongelman, joka on tuttu kaikille tekoälyn kanssa työskenteleville: AI-järjestelmät kuulostavat vakuuttavilta myös silloin, kun ne ovat väärässä. Sessiossa kerrottiin, miten vastuullinen tuote- ja käyttöliittymäsuunnittelu voi auttaa. Käytännön esimerkit tulivat NYT:n omista sisäisistä työkaluista, kuten Cheatsheetistä, jolla käsitellään laajoja datamassoja strukturoidusti.

SESSIO: Are U.S. Journalists Getting Lapped in the AI Race?

Amy Mitchell (Center for News, Technology & Innovation), Akintunde Babatunde (Centre for Journalism Innovation and Development), Gordon Saft (Rest of World)

Sessiossa käsiteltiin tutkimusta, joka vertailee tekoälyn käyttöönottoa uutisorganisaatioissa eri maissa.

SESSIO: The Blueprint for Success: How to Get Buy-In and Build AI Systems That Actually Work

Ryan Struyk (CNN), Heather Ciras McCarthy (Boston Globe), Rubina Fillion (The New York Times), Ole Reissmann (SPIEGEL-Group)

Monet toimitukset kokeilevat tekoälyä, mutta harvat onnistuvat muuttamaan kokeilut järjestelmiksi, joita toimittajat käyttävät paljon ja säännöllisesti. Paneeli käsitteli sitä, miten toimittajat, insinöörit ja tuotejohtajat saadaan samalle aaltopituudelle. Yhteinen teema oli se, ettei pelkkä tekninen toteutus riitä: muutosjohtaminen, luottamuksen rakentaminen ja yhteiset käytännöt ovat yhtä tärkeitä kuin itse työkalut.

TEEMA2: Tekoäly silmäparina — signaaliseuranta ja uutisten löytäminen

Listening at Scale: Building AI Tools for Audio and Video Monitoring

Kaveh Waddell (Verso)

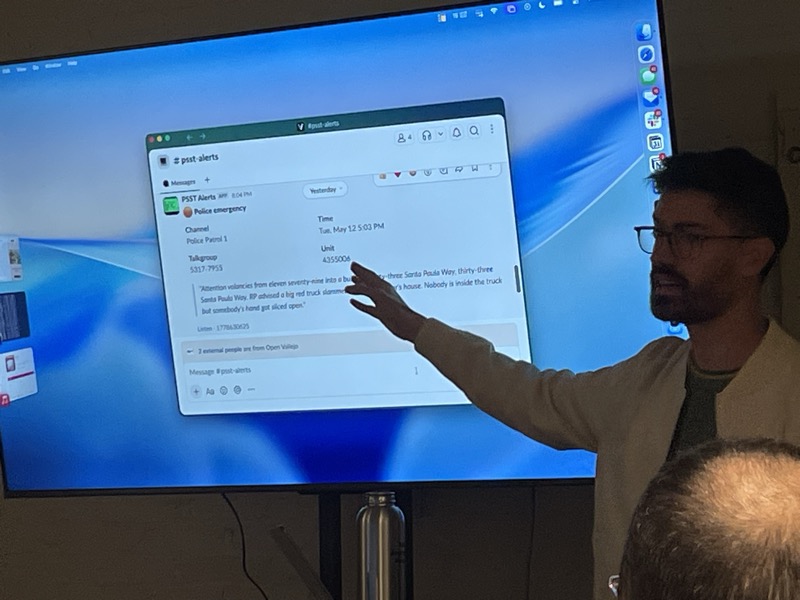

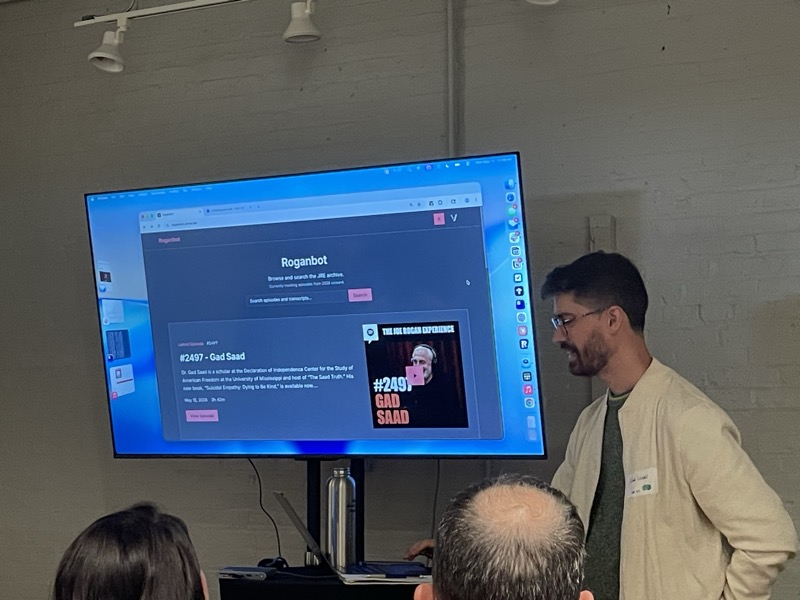

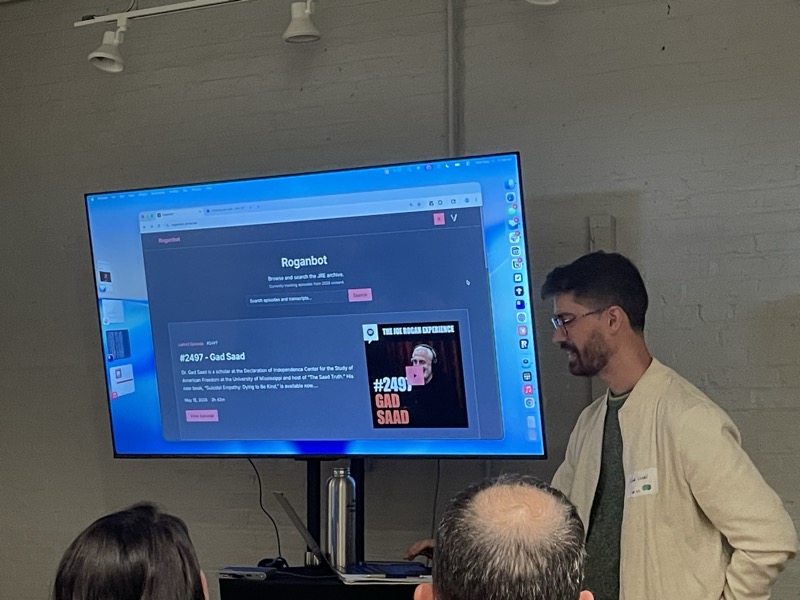

Toimittajat hukkuvat audioon ja videoon, jota he eivät pysty seuraamaan: kaupunginhallitusten kokoukset, poliisiradiot (Yhdysvalloissa), podcastit ja suoratoistosisällöt. Waddell esitteli, miten AI-järjestelmät pystyvät kuuntelemaan ja katsomaan puolestasi. Käytännön esimerkkejä oli kaksi: ensimmäisessä poliisiradiota seurataan Raspberry Pi:llä pyörivällä järjestelmällä, joka litteroi jokaisen puhelun automaattisesti ja lähettää hälytyksen Slack-kanavalle vain silloin, kun jotain uutisarvoista tapahtuu. Toinen esimerkki oli työkalu, joka litteroi kaikki Joe Roganin podcastit tekstuaalisesti etsittävään ja vertailtavaan muotoon.

Omat muistiinpanoni yo. sessioon:

Audio ja video ovat yhä alihyödynnetty kulma media-alalla suhteessa tekoälyyn, mistä puhuttiin myös tässä sessiossa.

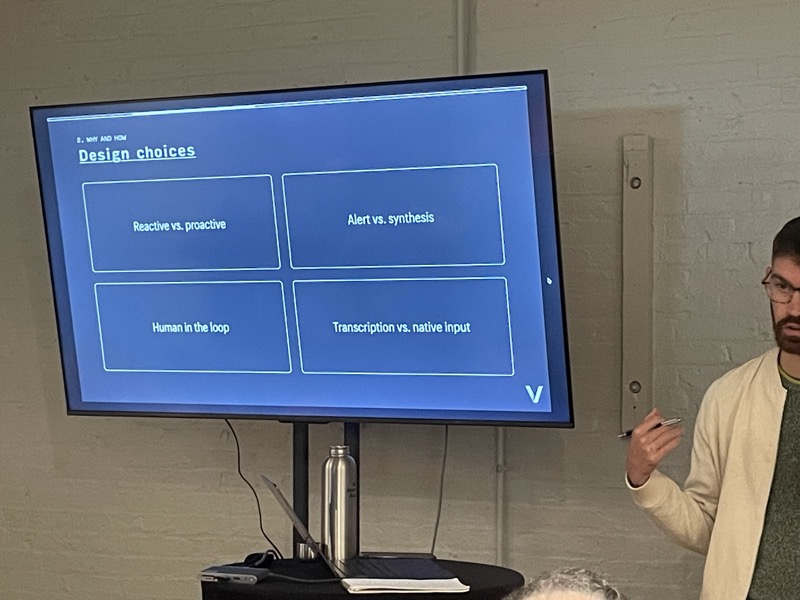

Waddell korosti, että poliisiradiotyökalu ei ole täydellinen, mutta se on tarpeeksi hyvä säästämään valtavasti aikaa. Waddell nosti esiin neljä keskeistä kysymystä ennen kuin alkaa rakentamaan tällaista monitorointijärjestelmää: reactive vs. proactive (milloin hälytät), human in the loop (missä kohdassa ihminen on mukana), alert vs. synthesis (yksittäisiä hälytyksiä vai yhteenvetoja) ja transcription vs. native input (käytätkö litteroitua tekstiä vai audiota suoraan syötteenä).

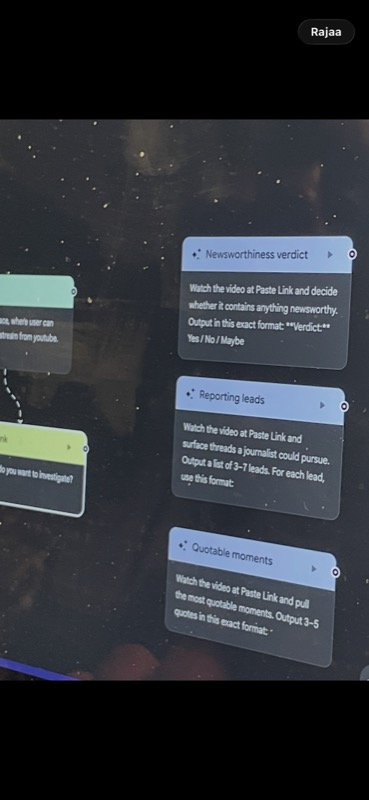

Kiinnostavaa tässä sessiossa: pääsimme kokeilemaan Googlen Opalia, jolla voi agenttisesti luoda sovelluksia. Käyttöliittymä muistuttaa hieman n8n- tai Make-automaatioalustoja. Opalia ei toistaiseksi voi käyttää Suomessa:

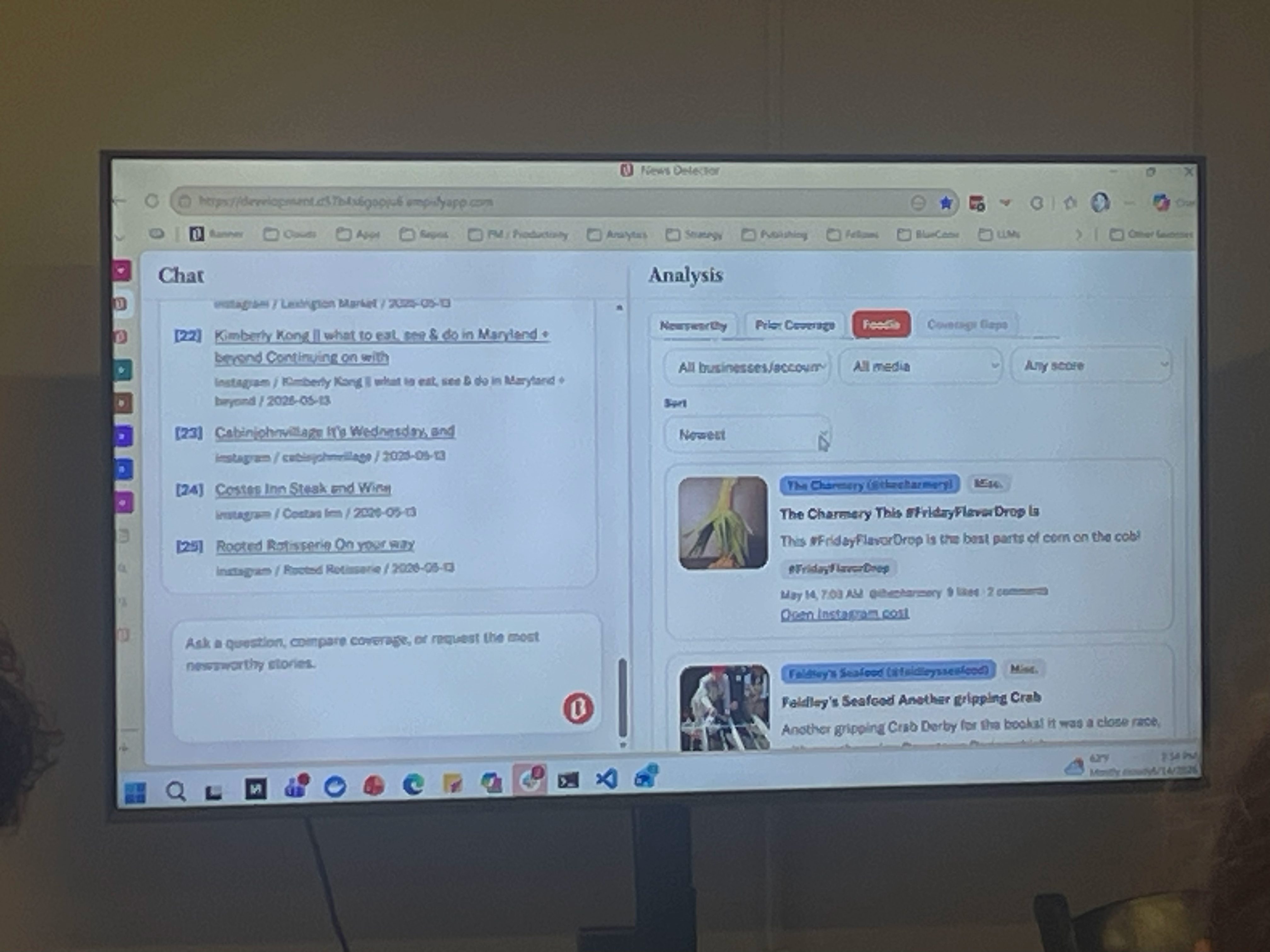

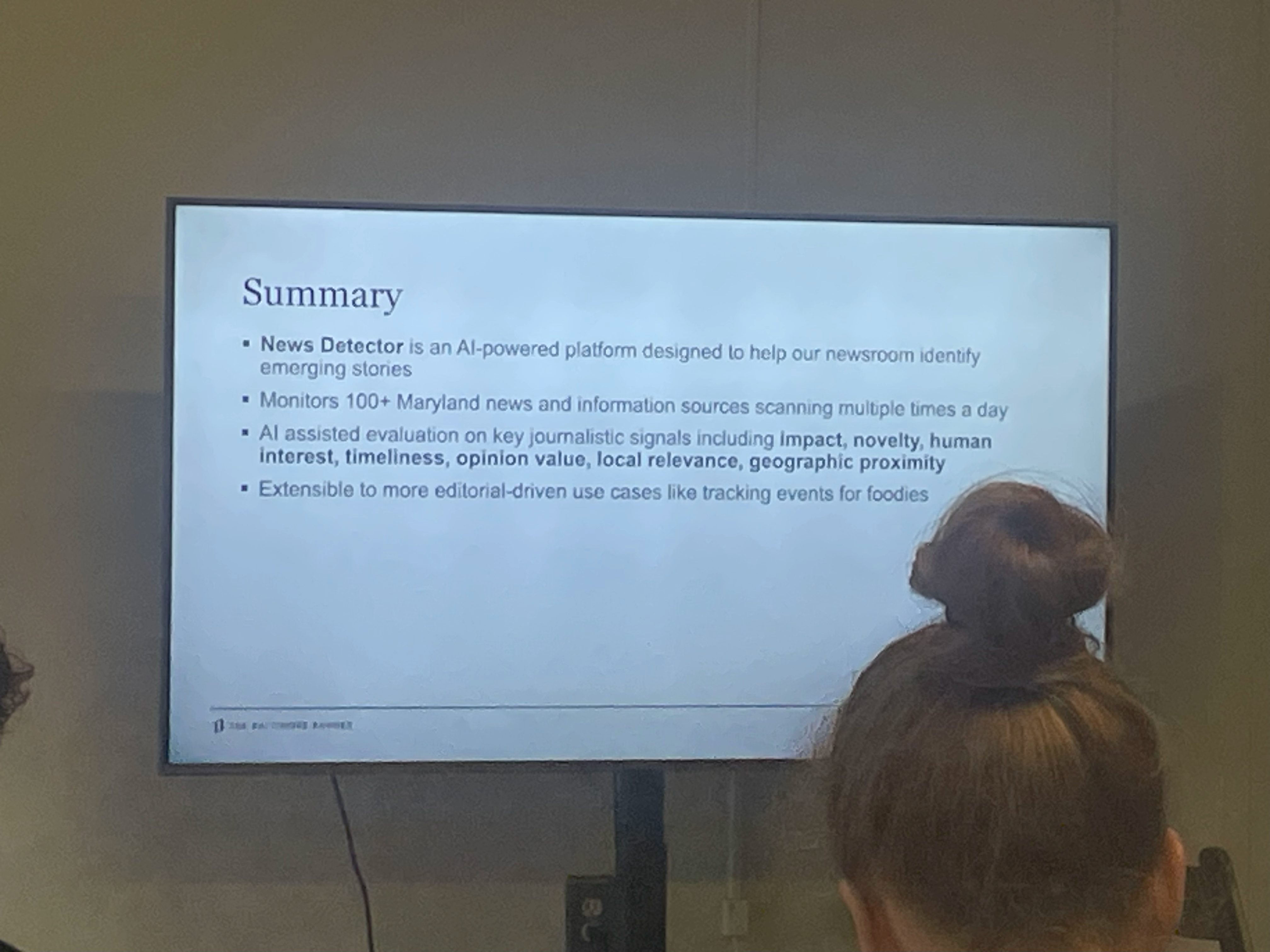

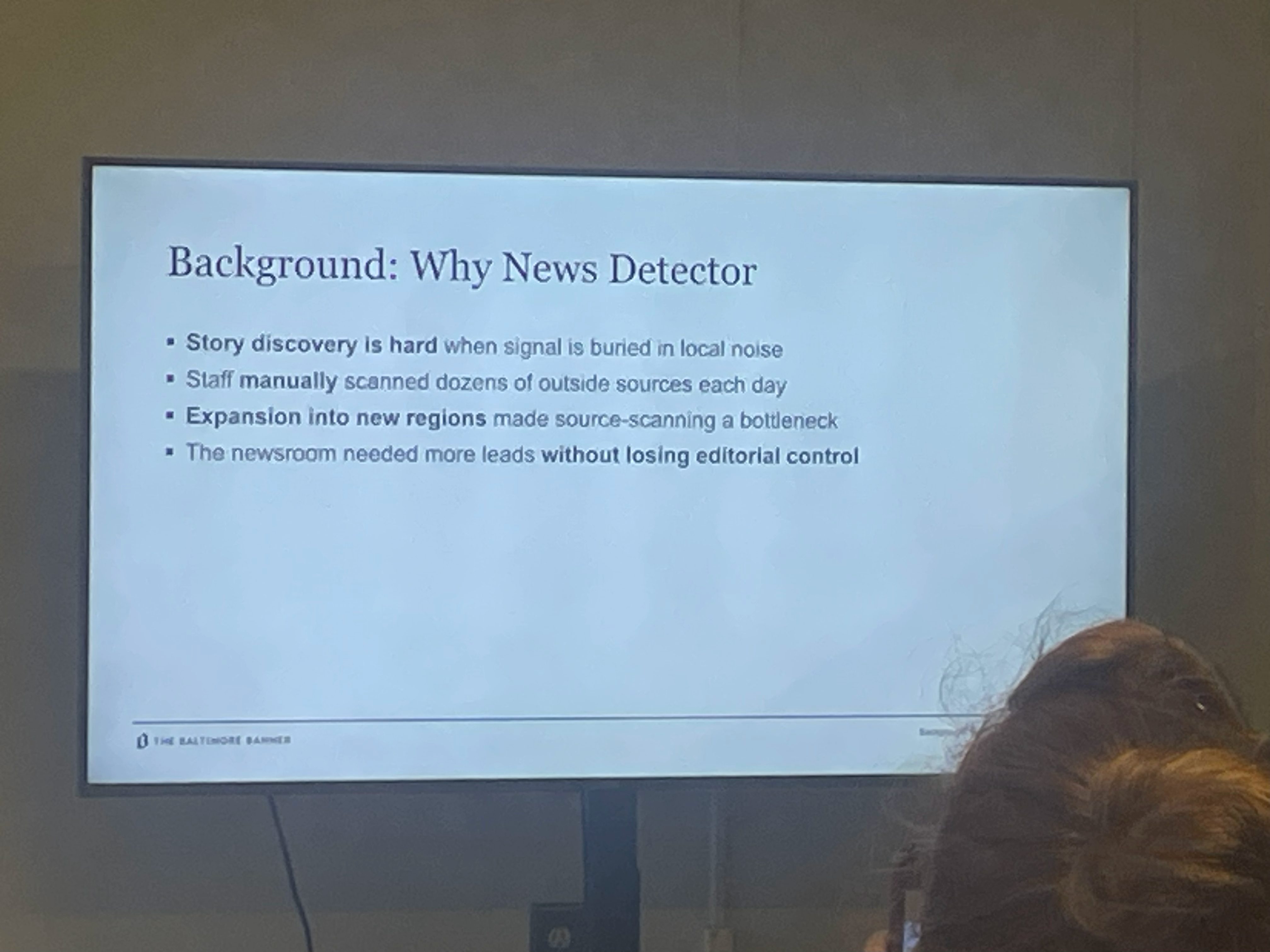

Building an AI Tool That Finds News Amid the Noise

Peter Rasmussen & Biswajit Ganguly (The Baltimore Banner)

Baltimore Bannerin News Detector -työkalu syntyi käytännön tarpeesta: toimittajat kävivät päivittäin manuaalisesti läpi kymmeniä ulkoisia lähteitä, ja laajentuminen uusille alueille teki siitä pullonkaulan. Ensimmäinen versio oli karsittu: se skreippasi paikallisia sivustoja, pisteytti aiheet ja lähetti ne toimitukselle Excel-tiedostona sähköpostilla.

Omat muistiinpanoni yo. sessioon:

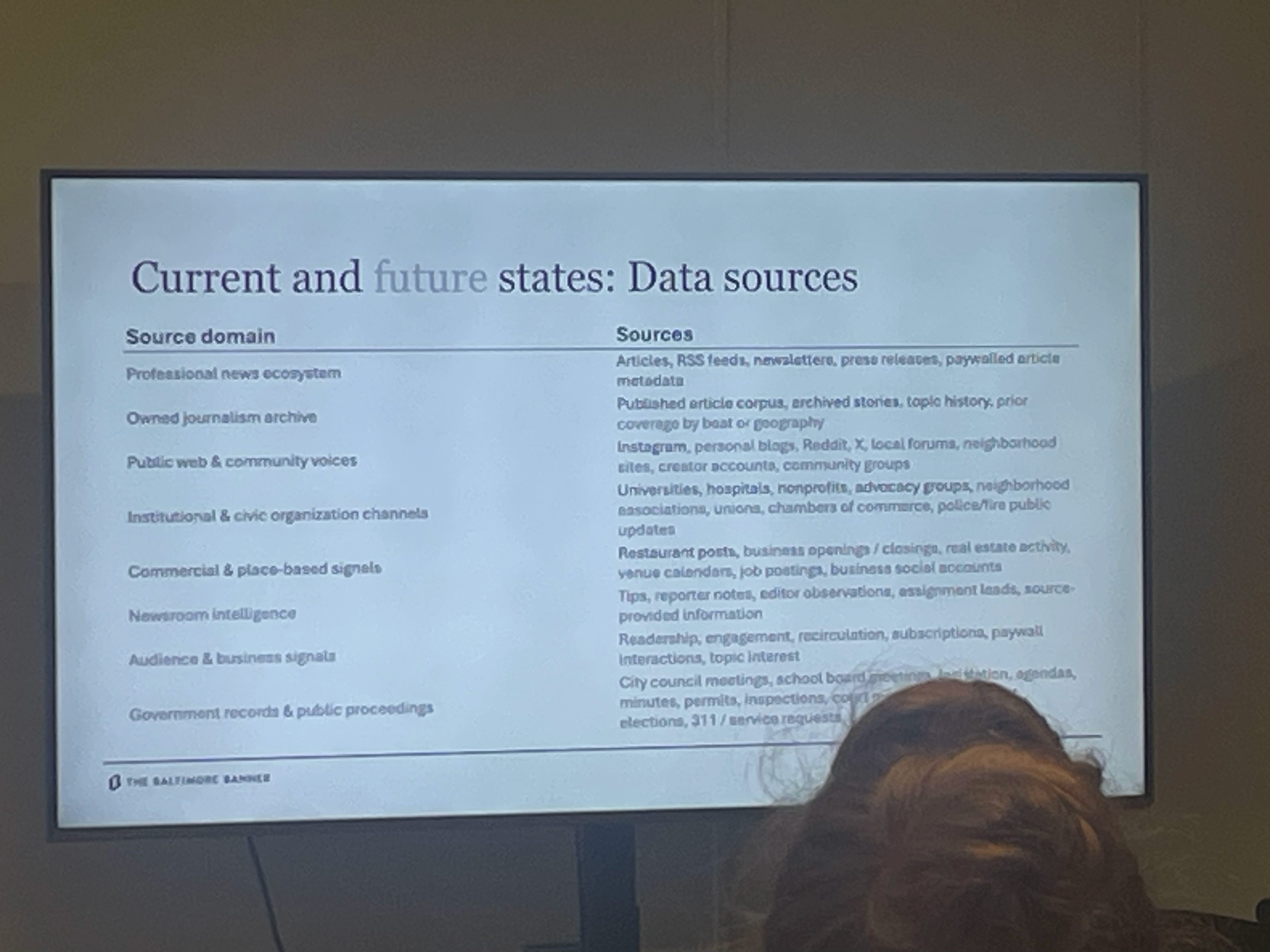

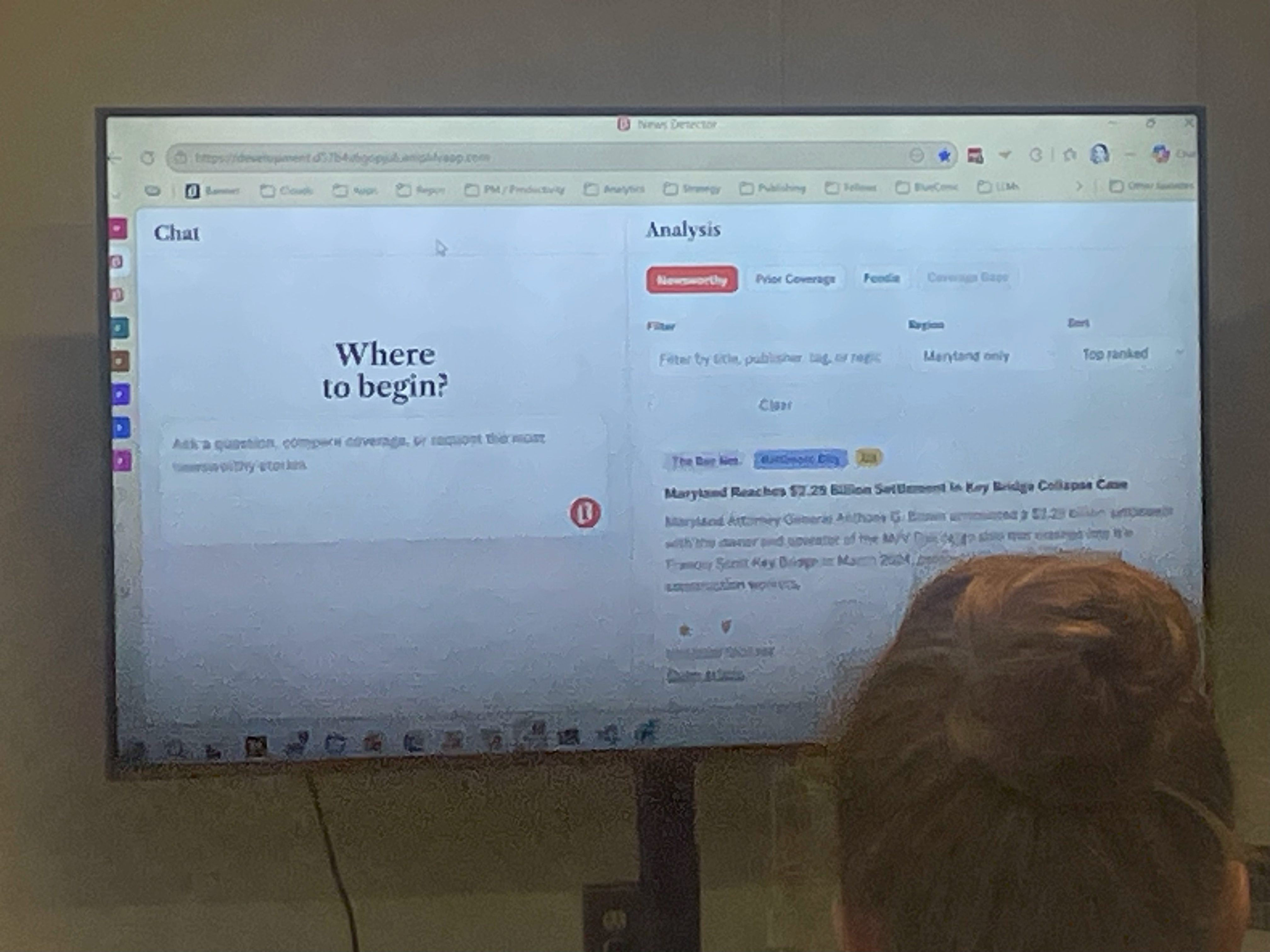

Amerikkalainen Baltimore Banner rakensi kolmessa kuukaudessa vaikuttavan näköisen uutissignaalien seurantatyökalun, jossa on yli sata lähdettä RSS-syötteistä someen ja skreipattuihin sivustoihin. Sen ytimessä on uutisarvopisteytys, joka pohjautuu ihmisten määrittelemiin uutisarvokategorioihin, joiden täsmäävyyttä päivitetään koko ajan tuoreiden esimerkkien pohjalta. Päivitys tarkoittaa käytännössä sitä, että toimittajat antavat säännöllisesti palautetta työkalun arviointikyvystä (peukku ylös tai alas), mikä parantaa sitä vähitellen.

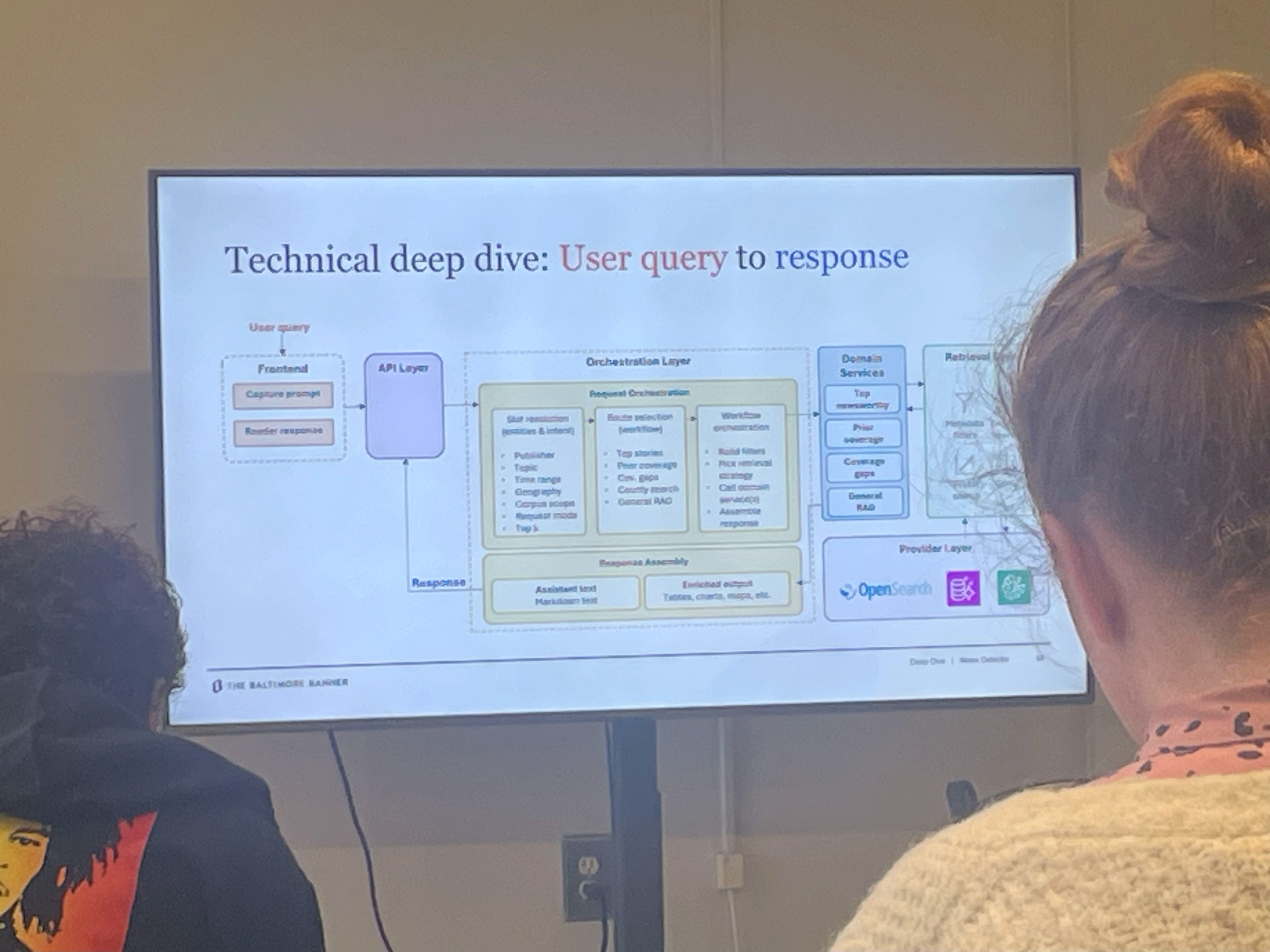

Rautalankaistettuna työnkulku on tällainen:

1. Kerääminen

Kone käy jatkuvasti läpi yli sataa lähdettä — uutissivustoja, somea (somessa hyödynnetään Apifyta), hallinnon asiakirjoja. Se siivoaa datan yhtenäiseen muotoon.

2. Pisteytys

Jokainen artikkeli tai sisältö menee tekoälyn läpi, joka arvioi, onko siinä vaikuttavuutta, konfliktia tai paikallisuutta ja missä määrin. Tekoäly tekee tulkinnan, mutta varsinainen numero lasketaan sääntöpohjaisella koodilla.

3. Haku ja vastaus

Kun toimittaja kysyy jotakin (kuten ”Mitä tärkeää tapahtui tällä viikolla Baltimoressa?”), järjestelmä hakee relevantin materiaalin kolmella tavalla: hakusanoilla, vektorihaulla ja metadatasuodatuksilla. Sitten se kokoaa vastauksen ja näyttää sen chatissa sekä rikastettuna listauksena vieressä.

Omat ajatukseni:

Sivustojen skreippaamisen eettinen puoli ei näytä Yhdysvalloissa lainkaan vaivaavan mediatoimijoita, tuntuu siltä että kaikki tekevät sitä. Tämä yllätti. Somen osalta Baltimore Bannerin työkalu käyttää Apifytä, jonka kanssa ainakin Euroopassa liikuttaisiin vähintäänkin harmaalla alueella. Asian toinen puoli on se, että usea yhdysvaltalaisemedia näyttää ottaneen uutisseurannan automatisoinnissa isoja harppauksia viimeisen vuoden aikana. Sanoisin, että alkavat olla jo paikoin edellä eurooppalaisia.

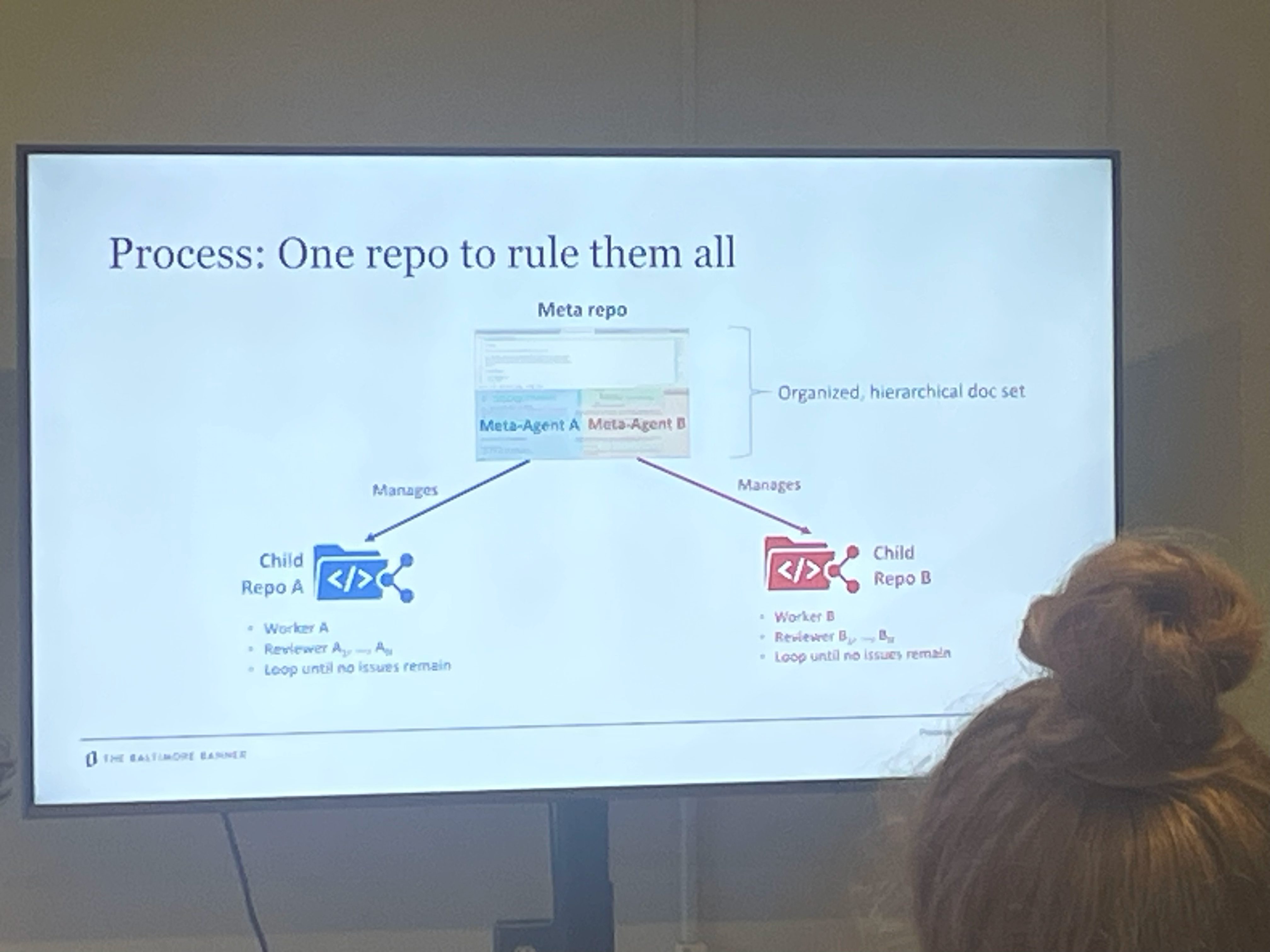

Baltimore Bannerin työkalun pääkehittäjä avasi teknistä filosofiaansa toteamalla, että heidän työkalunsa on vibekoodauksen hengessä rakennettu, mutta insinöörityön kurilla strukturoitu järjestelmä. Hän käytti termiä “vibe engineering”. Käytännössä pääkehittäjä vibekoodasi itse esimerkiksi käyttöliittymän työkalulle, vaikka korosti, että ei ole mikään ohjelmointimaailman moniottelija.

Why You Should Use AI to Monitor Local Meetings

Stephen Stirling & Kevin Hoffman (Philadelphia Inquirer)

Yhdysvalloissa on 90 000 paikallishallinnon yksikköä, ja uutismedia seuraa niistä yhä pienempää osaa. Stirling ja Hoffman esittelivät, miten raaka-audio tai -video kaupunginhallituksen kokouksesta muuttuu toimittajan kannalta hyödylliseksi tiedoksi.

Building Sparks: What We Learned Turning 1.2 Million Story Pickups Into an AI-Powered Recommendation Engine

Ken Romano & Cole Carter (Stacker)

Sessiossa kerrottiin, miten Stackerin 1,2 miljoonan jutun arkistoaineistosta rakennettiin AI-pohjainen suosittelumoottori journalisteille.

Building Beat Books From News Archives

Derek Willis (University of Maryland)

Useimpien uutismedioiden arkistot sisältävät paljon sellaista tietoa, jota harva toimittaja koskaan lukee. Willis Marylandin yliopistosta esitteli metodin, jolla tätä tietoa hyödynnetään. ”Beat book” on toimittajakohtainen tietopohja omasta vastuualueesta, koottu AI-avusteisesti arkistosta. Käytäntö toimii myös uusien toimittajien perehdyttämisessä.

TEEMA3: AI yhteistyökumppanina — agentit ja muisti

How a Three-Person Startup Added AI as the Fourth Co-Founder

Justin Bank & Ryan Kellett (The Independent Journalism Atlas)

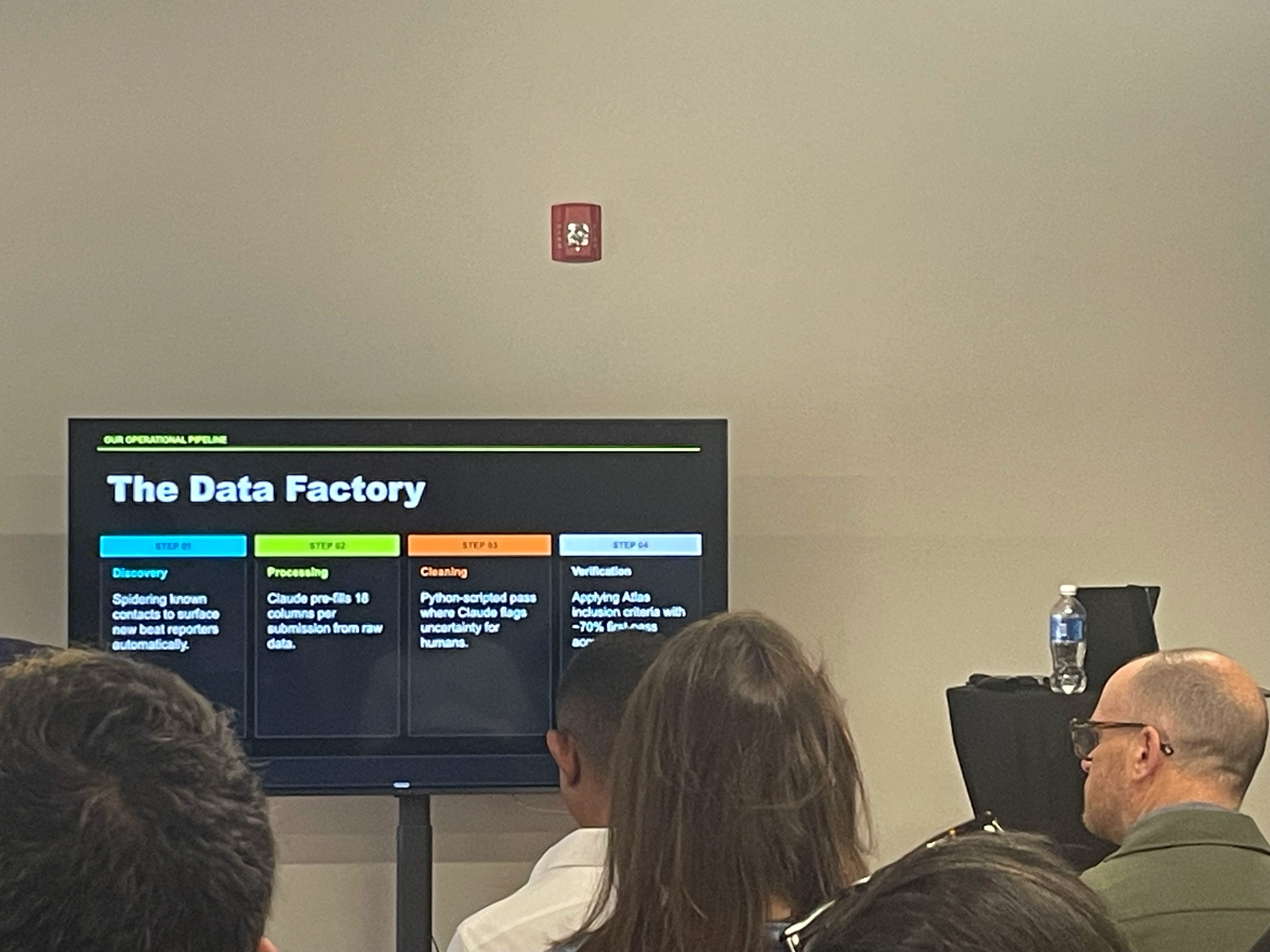

Independent Journalism Atlas on verifioitu tietokanta yli 1 200 vaikuttaja-journalistista (paremman suomenkielisen vastineen puutteessa käytän tätä), jotka tekevät journalismia perinteisten medioiden ulkopuolella. Startupilla on kolme perustajaa, ja lisäksi kolme muuta “founderia”, jotka ovat Claude-agentteja. Yhtiö julkaisee live-datatuotteita, interaktiivisia visualisointeja ja uutiskirjeitä, joista kaikki hoituvat ihmisen ja tekoälyn yhteistyönä.

Omat muistiinpanoni yo. sessioon:

Tämä sessio oli tapahtuman kiinnostavimmasta päästä. Heillä on kolme nimettyä agenttia: Ryan hoitaa datan puhdistuksen ja metodologian, Justin kehityksen ja visualisoinnit, Liz strategian ja kumppanuudet. Jokainen agentti on saanut roolin, kontekstin ja muistin.

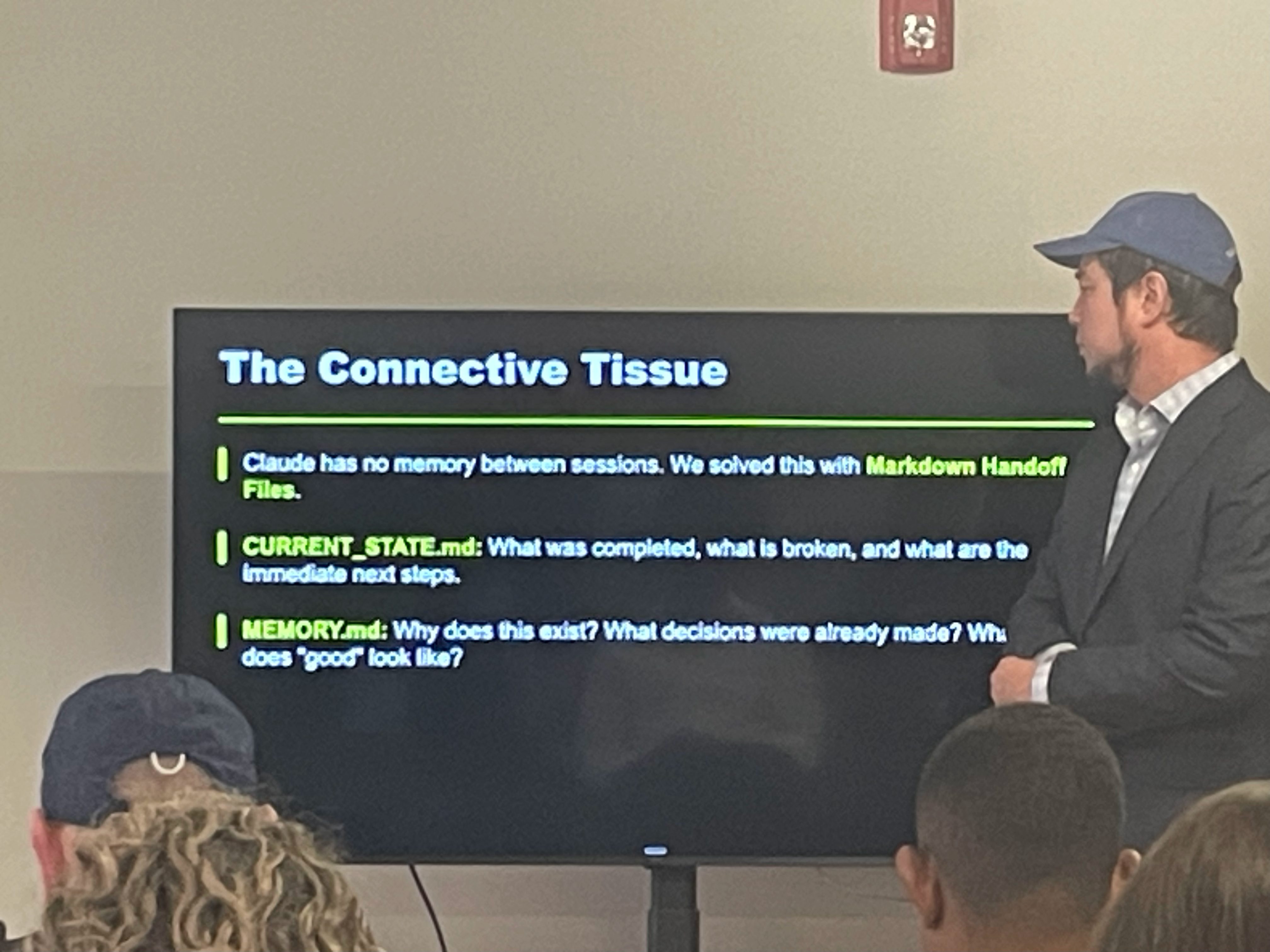

Muistiongelman he ratkaisivat kahdella Markdown-tiedostolla: CURRENT_STATE.md (mitä on tehty, mikä on rikki, mitkä ovat seuraavat askeleet) ja MEMORY.md (miksi tämä on olemassa, mitä päätöksiä on tehty, miltä ”hyvä” näyttää).

Tämä käytäntö herätti kysymyksiä: yrityksen jokainen palaveri, myös 1:1-keskustelut, nauhoitetaan ja litteroidaan Granola-nimisellä ohjelmalla ja viedään tekoälylle .md-tiedostona. ”Me voimme tehdä näin — emme ole suuri media.”

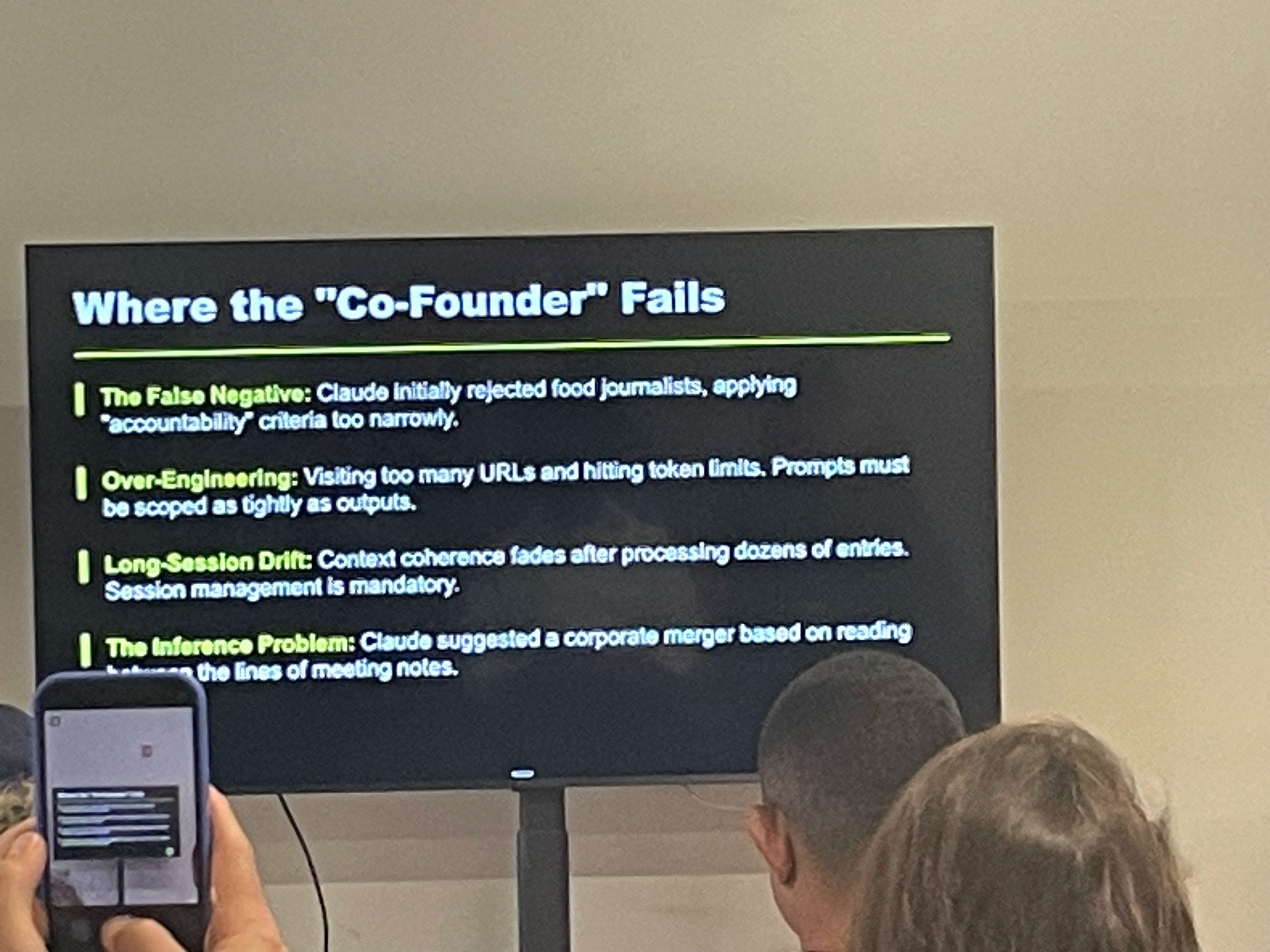

He kertoivat myös suoraan, missä tällainen agenttinen co-founder-malli epäonnistuu: Claude hylkäsi aluksi ruokajournalistit soveltaen ”accountability”-kriteeriä liian kapeasti. Pitkissä sessioissa tulee joskus ongelmia. Kerran Claude ehdotti yrityskauppaa lukemalla “rivien välistä” palaverimuistiinpanoista. Tärkein opetus oli, että tekoälylle on annettava selkeä rooli, ei vain käyttötapauksia referenssiksi.

AI Coding Agents for Investigative Journalism

Nick Hagar (Northwestern University)

Sessiossa käytiin läpi sitä, miten Claude Code muuttuu nopeasta mutta riskialttiista assistentista järjestelmälliseksi yhteistyökumppaniksi. Keskeinen viesti oli, että: arvot kuten ”ole läpinäkyvä” eivät riitä sellaisenaan, vaan ne on kyettävä muuttamaan konkreettisiksi toimintasäännöiksi. Hagarin mielestä hyvä skill sisältää seuraavat asiat (en käännä näitä suomeksi, ettei ajatus katoa käännettäessä): Purpose, Allowed work, Review gates, Preservation rules, Documentation outputs, Claim discipline ja Stop conditions.

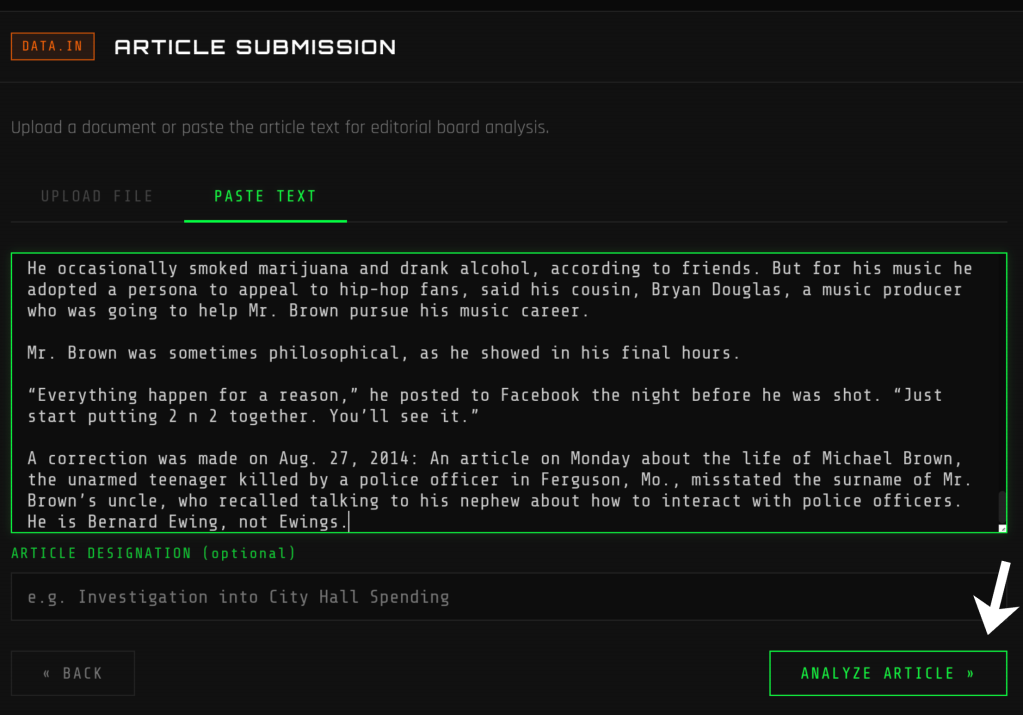

A Decentralized Agentic-AI Editorial Board for an International Newsroom

Areeba Fatima (Columbia University) & Angela Eichhorst (CT Mirror)

Session osallistujat prototyyppasivat pienryhmissä AI-toimitusrakenteen, jossa eri agentit vastaavat eri osa-alueista, kuten faktantarkistuksesta tai otsikoinnista. (vähän samaan tapaan kuin AI:n johtama uutistoimitus -hanke Suomen Tampereella, mutta)

What’s Your Problem?

Paige Moody (Hacks/Hackers & Big Local News), Jake Kara (Hacks/Hackers Newsroom AI Lab)

Session lähtökohtana oli, että monissa AI-kehitysprojekteissa ratkaistava ongelma on jäänyt epämääräiseksi. Osallistujat harjoittelivat oman ongelmansa terävöittämistä ennen kuin tekoäly otetaan mukaan.

TEEMA4: Konkreettiset työkalut toimittajan arjessa

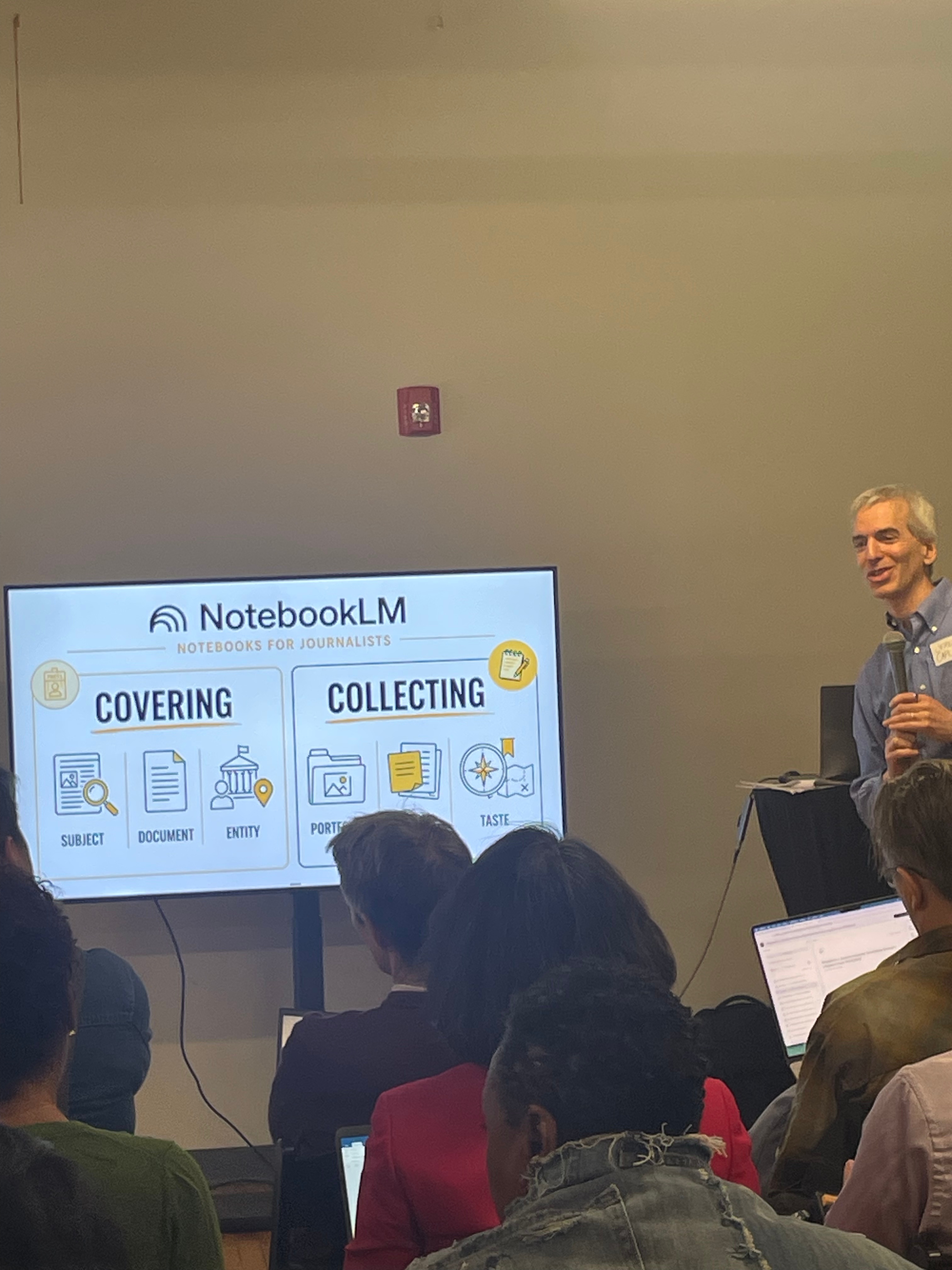

Next-Gen NotebookLM: 9 Bold and Impactful New Things Newsrooms Can Do

Jeremy Caplan (CUNY Newmark Graduate School of Journalism)

Caplan esitteli yhdeksän käyttötapaa, jotka muuttavat NotebookLM:n tiivistämistyökalusta kriittiseksi yhteistyökumppaniksi: ne haastavat lähteitä, paljastavat aukkoja ja testaavat oletuksia sen sijaan, että vain tiivistäisivät sisältöä. NotebookLM:n perusarkkitehtuuri koostuu kolmesta osiosta: Sources (lähteet), Explorer (haku luonnollisella kielellä) ja Studio (tuotosten luominen).

Iso suositus muuten Caplanin Wondertools-uutiskirjeelle!

Omat muistiinpanoni yo. sessioon:

NotebookLM on edelleen alikäytetty työkalu journalismissa. Itselleni se on tuttu, mutta aina uusimmista ominaisuuksista ei ehdi pysyä kärryillä. Caplanin esityksen perusteella on kokeiltava ainakin Data Tablesia, joka muuttaa minkä tahansa lähdemateriaalin taulukkomuotoon. ”Very powerful”, totesi Caplan.

Uusi ominaisuus on myös automaattinen lähteiden järjestäminen, eli jos olet liittänyt työkaluun vaikka 50 lähdettä, tekoäly järjestää ne nyt loogisesti halutessasi. Studio-osion tärkein vinkki oli, että yhä useampaa toimintoa voi nyt räätälöidä itse. “Älä paina nappia suoraan, vaan kustomoi kolmen pisteen takaa, kerro mitä haluat. Lopputuloksessa on iso ero.”.

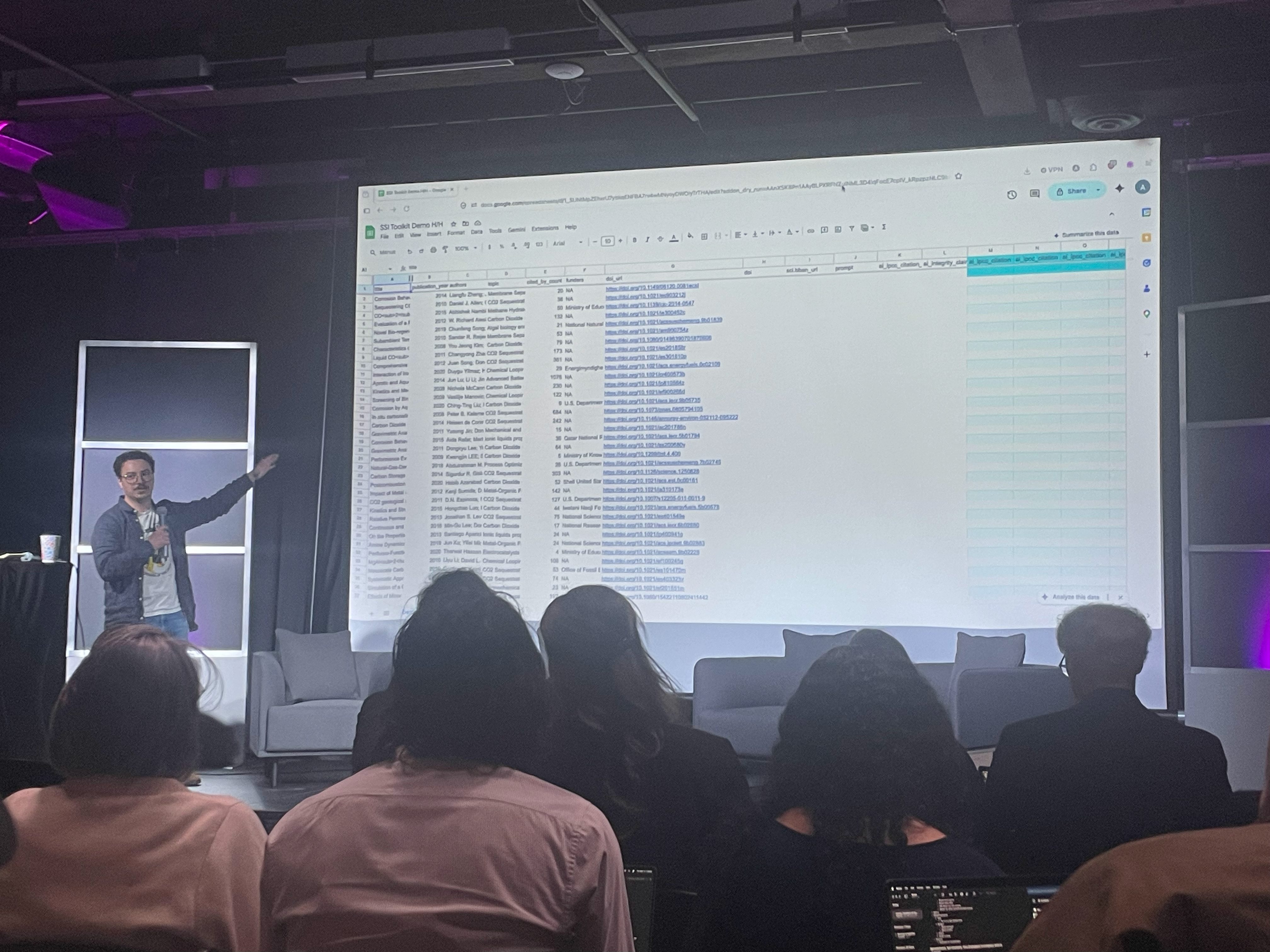

Spreadsheets, Not Chatbots: How ProPublica Investigates With AI

Aaron Brezel (ProPublica)

”Chatbots are claw machines to pull up stuffed animals. It is not ideal for investigative reporting.” Tämä oli Brezelin lähtökohta: chatbotit ovat arvauskoneita, eivätkä ideaaleja täsmällisyyttä vaativaan työhön.

ProPublicassa tutkiva journalismi tapahtuu jo nyt usein taulukoissa (Google Sheetseissä), jollaisen luotettava käsitteleminen chatbotin kautta on hankala ratkaisu. ProPublican vastaus on Spreadsheet Inference (SSI), jossa Google Sheets kytketään Geminin REST API:iin rivi kerrallaan. Tällöin AI tekee tulkinnan ja deterministiset säännöt laskevat lopputuloksen.

Omat muistiinpanoni yo. sessioon:

Tämä oli harvoja sessioita, joissa oli vaikea pysyä kärryillä, mitä tässä oikein tapahtuukaan. En ollut tietoinen, että Sheetsiin pystyy kytkemään Geminin rajapintaa rivi riviltä. Mutta demotus oli vaikuttava. SSI Toolkit löytyy GitHubista: github.com/propublica/gas-ssi-toolkit/

Brezel heitti heti alkuun erinomaisen pointin: se mikä toimii tekoälyn hyödyntämisessä yhdessä mediassa, ei välttämättä toimi ollenkaan toisessa. Tämä johtuu siitä, että medioilla on eri kohderyhmät, eri tavoitteet ja erilaiset toimintakulttuurit. ProPublica on tutkivaan journalismiin erikoistunut voittoa tuottamaton järjestö, jonka asema mediakentässä on monella tapaa erikoinen. Se ei esimerkiksi pidä juttujaan vain omilla sivuillaan, vaan tekee paljon yhteistyötä.

AI as Your Data Desk Partner

Lauren Malkani (Seven Mile Media) & Nick Harbaugh (X-energy)

Sessiossa näytettiin, miten datasetti muuttuu juttuprototyypiksi Claude Coden avulla luonnollisella kielellä kysymällä.

Make Your Own Personal Coach

Sonya Quick (CalMatters & The Markup)

Quick kertoi, miten rakensi oman AI-valmentajan, joka haastaa hänen omaa ajatteluaan.

Using MCP to Analyze Text and Visualize Data

Hong Qu (Harvard Kennedy School)

Sessio näytti vaihe vaiheelta, miten rakenteistamaton teksti muuttuu taulukoiksi ja lopulta selkeiksi visuaalisiksi tuotoksiksi MCP:n avulla. Metodilla on potentiaalia erityisesti suurten tekstimassojen kuten poliittisten puheiden tai oikeusasiakirjojen systemaattisessa analyysissa.

MCP on eräänlainen tekoälysovellusten USB-portti.

Large Language Mathematicians: Public Records in Record Time

Tyson Bird (American City Business Journals)

American City Business Journals halusi työkalun, joka vinkkaa juttuaiheita julkisista asiakirjoista, mutta törmäsi jatkuvasti laskuvirheisiin. Sessiossa kerrottiin, miten ongelma ratkaistiin yhdistämällä kielimallin tekstinymmärrys deterministiseen laskentaan. Siinä tekoäly tunnistaa relevantit luvut ja kontekstin, mutta varsinainen matematiikka jätetään koodille.

TEEMA5: Rakentaminen ilman perinteistä ohjelmointitaustaa — vibekoodaus (tai kansalaiskoodaus)

Vibe Coding Jam Sessions

Kummankin päivän ohjelmassa oli avoin vibekoodaussessio ilman esitäytettyä esityslistaa: tuo läppäri, kerro mitä rakennat, jaa vinkit. Sessio oli avoinna kaikille, myös niille joilla ei ole perinteistä ohjelmointitaustaa.

From Concept to Code: Building Prototypes & Agents With Google AI

Etan Horowitz (Google)

Googlen sessio tutustutti osallistujat Googlen AI -ekosysteemiin, johon kuuluu mm. NotebookLM, Gemini, Stitch ja Flow. Tarkoituksena oli osoittaa, miten näitä työkaluja voidaan yhdistää uutistyöhön toisiinsa kytkettyinä komponentteina. Erityisesti Flow herätti kiinnostusta osallistujissa.

Rapid AI Prototyping Inside the Minnesota Star Tribune

Frank Bi (The Minnesota Star Tribune)

Kun Minnesota Star Tribune rakensi ensimmäisen yleisölle suunnatun AI-tuotteensa, prosessi vaati ”pirates in the navy” -asenteen. Bi kertoi, miten toimituksen sisällä piti luoda tilaa nopeille kokeiluille ilman, että jokainen askel vaati kymmentä hyväksyntää. Ydinajatus oli, että nopea prototyyppi, joka epäonnistuu, on arvokkaampi kuin pitkä suunnitteluprosessi, joka ei tuota mitään.

Pinpoint: Re-Thinking Our Product for the Age of Generative AI

Yuval Shukroon (Google)

Google Pinpoint on tutkivien toimittajien työkalu suurten dokumenttimäärien analysointiin. Sessiossa Googlen tiimi kertoi, miten he ovat miettineet Pinpointia uudelleen generatiivisen tekoälyn aikakaudella ja miten tuotetta on suunniteltu käyttäjille, joiden tekninen osaaminen vaihtelee suuresti.

TEEMA6: Vastuu, juridiikka ja riskit

Future-Proofing Facts

Hilke Schellmann (NYU & Princeton CITP), Loreben Tuquero (PolitiFact)

Schellmann ja Tuquero esittelivät menetelmiä, joilla toimittajat voivat rakentaa kestävämpää todentamisprosessia tekoälyn ja synteettisen sisällön aikakaudella.

What About the Lawsuits? Copyright Litigation, Bot Scrapers, and the Future of the Open Web

Monika Bauerlein (Center for Investigative Reporting), Kevin Bankston (CDT), Meredith Rose (Public Knowledge)

Muutamat kustantajat ovat nostaneet kanteita tekoäly-yhtiöitä vastaan. Sessio purki, mitä oikeudenkäynneissä on tähän mennessä tapahtunut, mitkä kysymykset ovat avoimia ja miten lopputulos voi vaikuttaa siihen, mitä toimituksissa on sallittua tehdä tekoälyn kanssa.

AI Crawlers and the New Publisher Reality: Lessons From the Newspack Network

Joe Boydston (Newspack), Tracy Becker (Automattic)

Newspack-verkoston keräämä data paljasti, miltä käytännössä näyttää AI-ajan tuoma liikenne uutismedioihin: mitkä bottityypit liikkuvat, milloin ja kuinka paljon. Tieto auttaa kustantajia päättämään, miten reagoida.

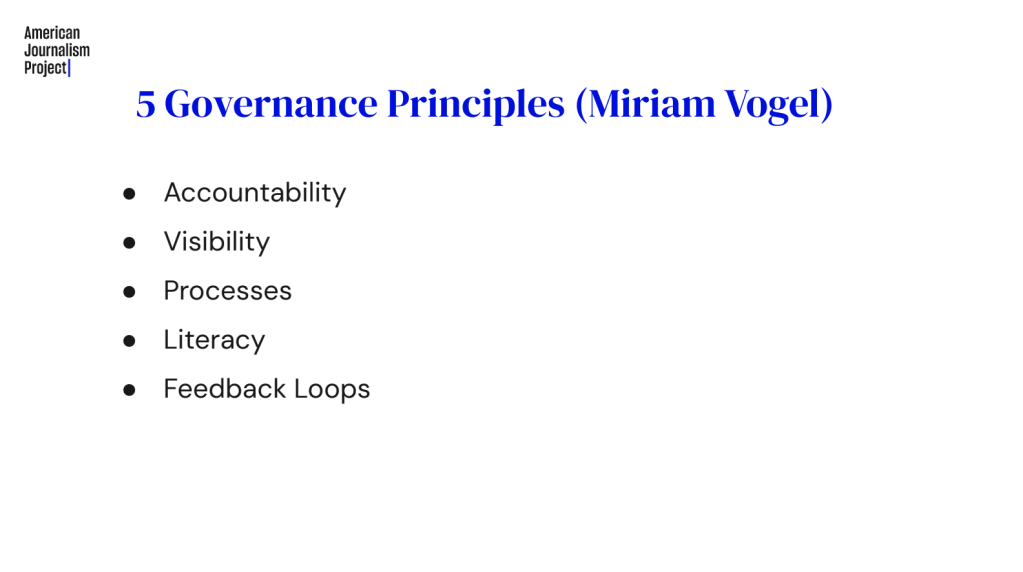

Move Fast Without Breaking Trust: Challenges in AI Governance for the Future of News

Justin Hendrix (Tech Policy Press), Liam Andrew (American Journalism Project), Erica Osher (NPR)

Paine kokeilla tekoälyä luo jännitettä uutisorganisaatioissa. Sessio purki tätä jännitettä käytännöllisesti: miten rakennetaan prosessit, joissa voidaan liikkua nopeasti menettämättä journalistista luottamusta.

AI Without Losing the Human Touch: Sustaining Mental Muscle in AI-Assisted Journalism

Vania André (The Haitian Times)

Sessio otti esille kysymyksen, jota muut lähestyivät varovaisemmin: mitä tapahtuu kognitiivisille taidoille, kun tekoäly ottaa yhä enemmän perustehtäviä hoitaakseen? André esitteli menetelmiä sille, miten toimitukset voivat säilyttää ihmisen kriittisen ajattelun myös silloin, kun apuvälineitä on käytettävissä enemmän kuin koskaan.

Do We Really Need an AI Use Policy?

Alex Mahadevan (Poynter), Emma Cosgrove (Business Insider)

Poynterin Alex Mahadevan ja Business Insiderin Emma Cosgrove esittelivät skenaarioita, joissa käytäntöjen puuttuminen on johtanut ongelmiin, ja skenaarioita, joissa liian jäykät säännöt ovat estäneet hyödyllisten kokeilujen tekemisen.

Evaluating A.I. in the Newsroom: From Patterns to Benchmarks

Nikita Roy (Newsroom Robots Lab), Duy Nguyen (The New York Times), Teresa Mondría Terol (NPR)

Newsroom Robots Lab, NYT ja NPR esittelivät mittareita, joilla voidaan vertailla eri mallien suorituskykyä toimituksellisissa tehtävissä.

How Law Firms Manage Document-Heavy Investigations, and How Journalists Can Use These Tools

Chris Miles & Aaron Patton (Everlaw)

Tutkivat toimittajat ja asianajajat tekevät samantyyppistä työtä: suuria dokumenttimääriä, tutkimista, seuraamista. Everlaw on lakifirmoille rakennettu dokumenttien tutkimisalusta, ja sessio esitteli miten sen metodeja voidaan tuoda journalistien käyttöön.

TEEMA 7: Yleisöt, sisältö, personointi ja liiketoiminta

The Survey That Asks ”One More Thing” (on Purpose)

Patrick Boehler & Madison Karas (Gazzetta)

Perinteiset kyselyt kysyvät ennalta määriteltyjä kysymyksiä. Adaptiiviset kyselyt tekevät jotain muuta: AI seuraa vastausta ja kysyy yhden lisäkysymyksen, joka on relevantti juuri sen ihmisen vastaukselle. Gazzetta on rakentanut tällaisen järjestelmän, ja sessio esitteli miten pienten vakiokysymysten ja AI-ohjatun jatkokyselyn yhdistelmä tuottaa rikkaamman kuvan yleisöstä kuin perinteinen lomake.

Using AI to Customize Content & Connect Readers

Ava Motes (Center for Media Engagement, University of Texas at Austin)

Miten AI voi auttaa toimituksia edistämään terveempää puoluerajat ylittävää vuoropuhelua, rauhoittamaan räyhääviä kommenttiosioita ja tavoittamaan paremmin monimuotoiset yleisöt? UT Austinin Media Engagement Center esitteli tutkimuspohjaisia käytännöllisiä menetelmiä.

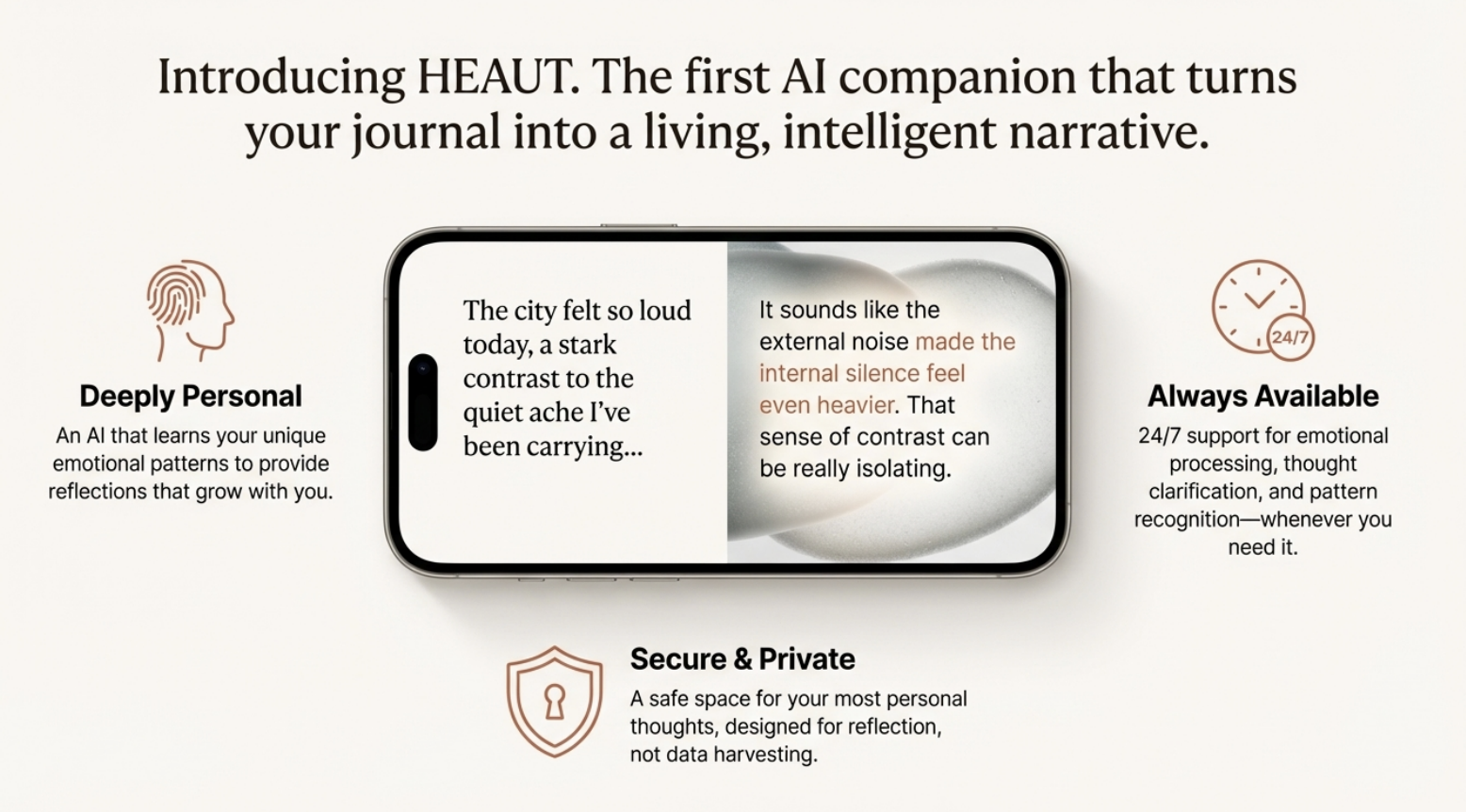

From AI Journaling to the Mind Economy: Rethinking How Journalism Understands Human Narratives

Dexiang ”Darren” Gao (HEAUT Foundation)

HEAUT on AI-päiväkirjaalusta, joka muuttaa henkilökohtaisen kirjoittamisen strukturoiduksi tiedoksi. Sessio esitteli ”Mind Economy” -konseptin: henkilökohtaisista narratiiveista tulee tietopääomaa, jota voidaan käyttää journalismin lähdeaineistona.

AI as a Power Assist for Political Accountability Reporting

Chandran Sankaran (Gigafact), Emily Le Coz (Suncoast Searchlight), Kevin Grant (Allbritton Journalism Institute)

Poliitikkojen lausunnot ovat hajallaan ympäri nettiä: Gigafact on rakentanut alustan, joka kokoaa nämä, analysoi ne ja auttaa toimittajia.

Build the News Industry’s AI Business Plan

Richard Lui (MS NOW / CAREGenome), Andy Pergam (Knight Center, ASU)

Sessio haastoi osallistujia rakentamaan käytännöllistä liiketoimintasuunnitelmaa sille, miten uusmedia voi hyödyntää asemaansa sen sijaan, että odottaa yhtiöiden tekevän sen heidän puolestaan.

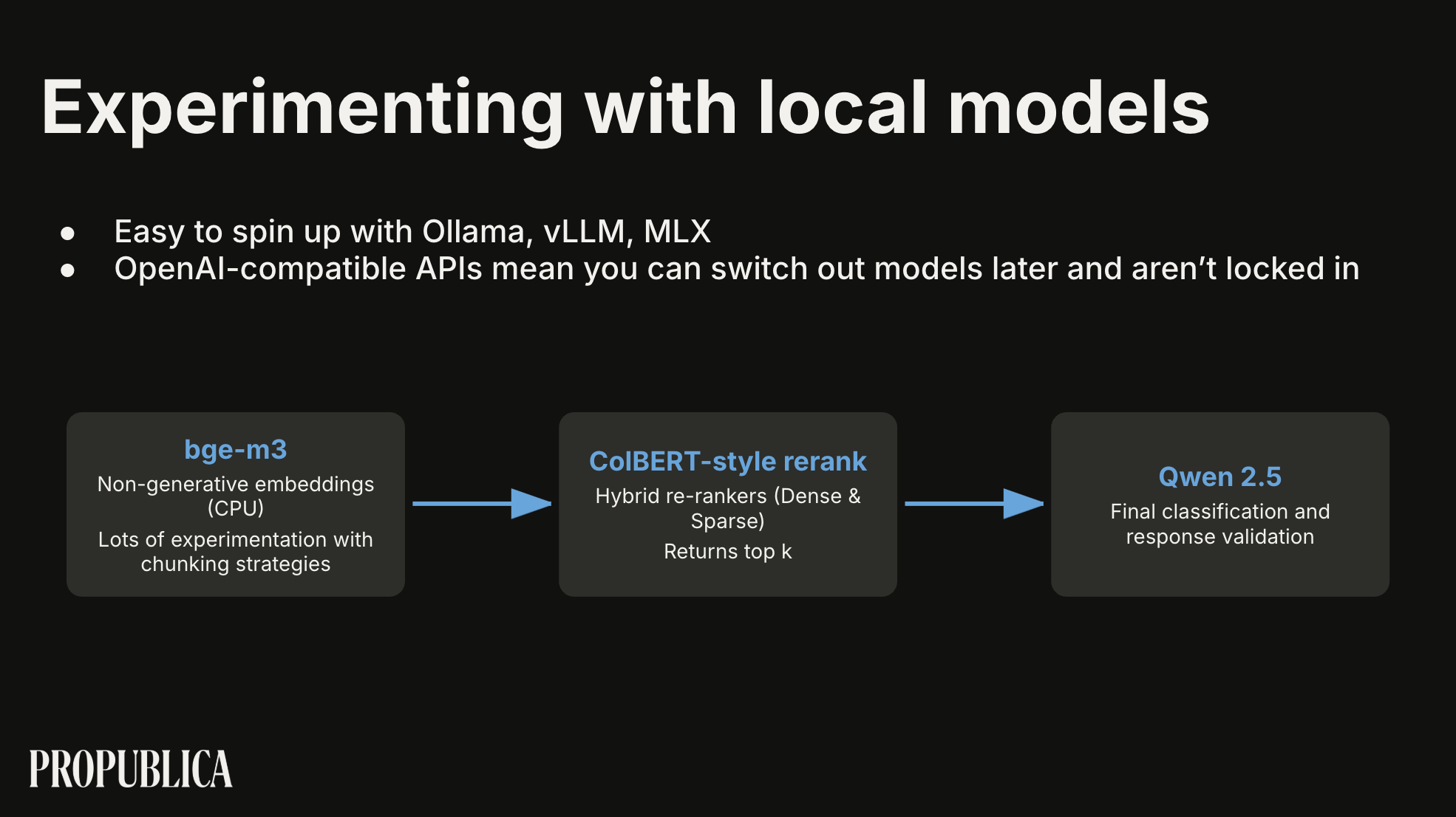

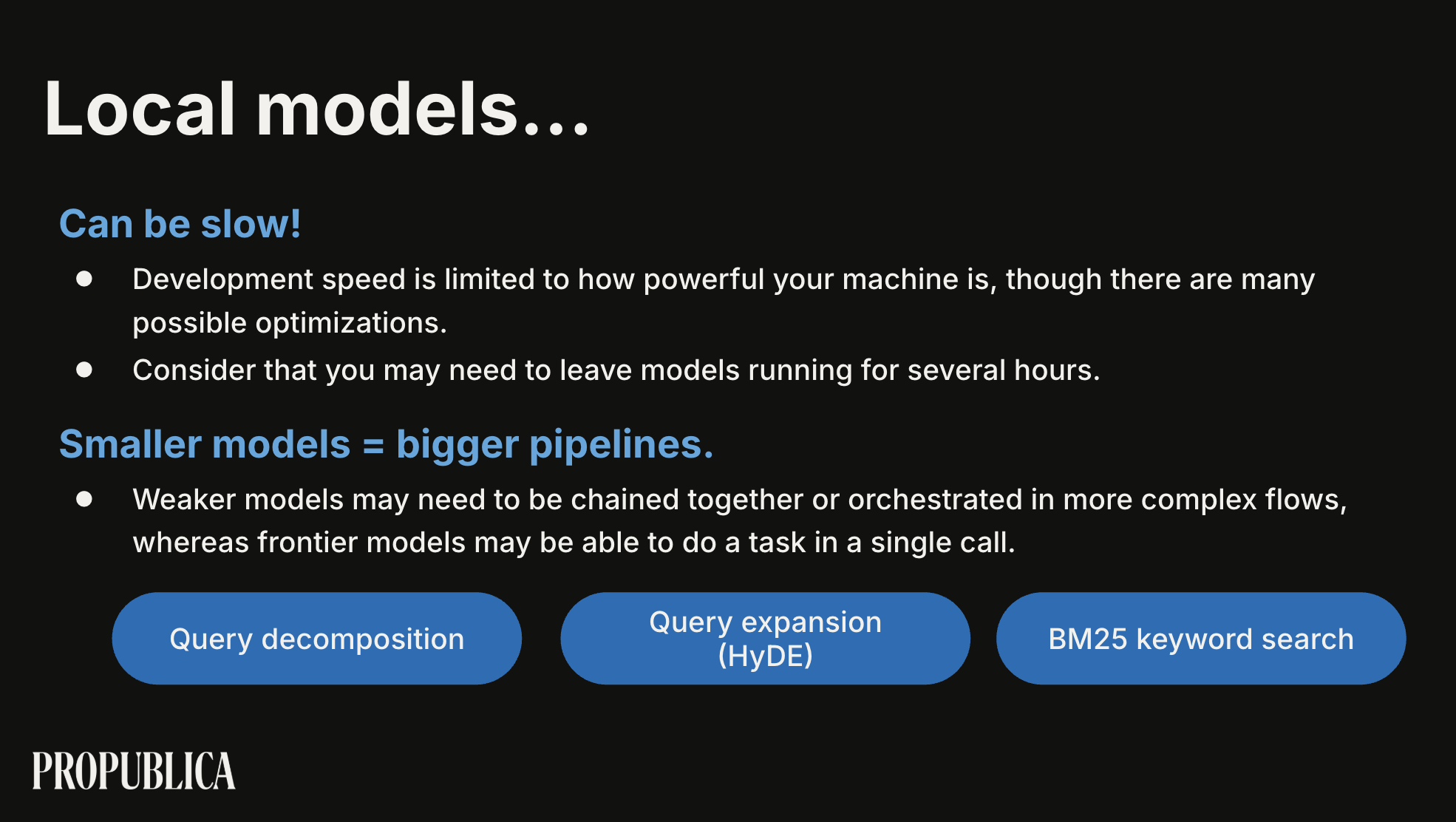

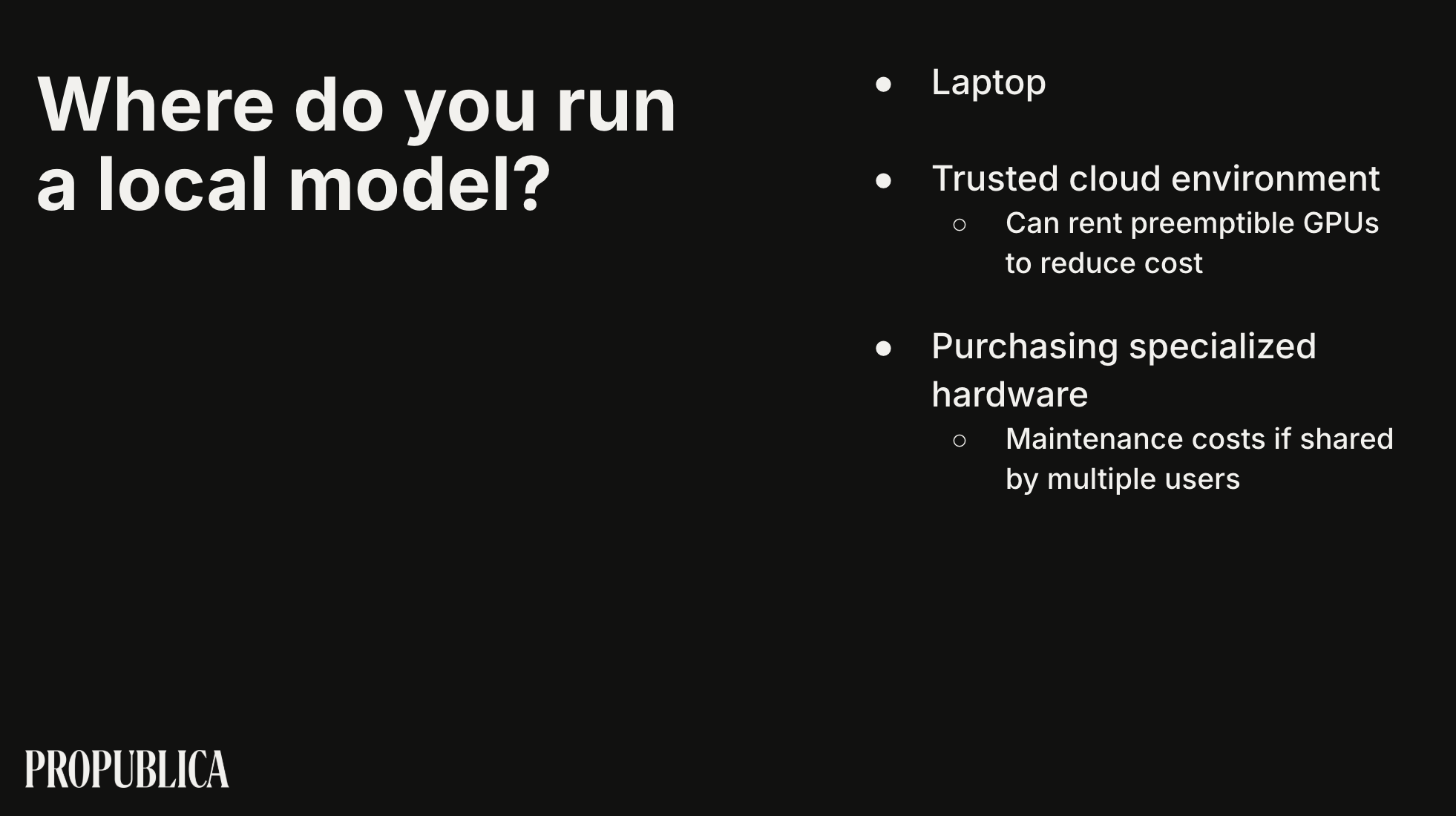

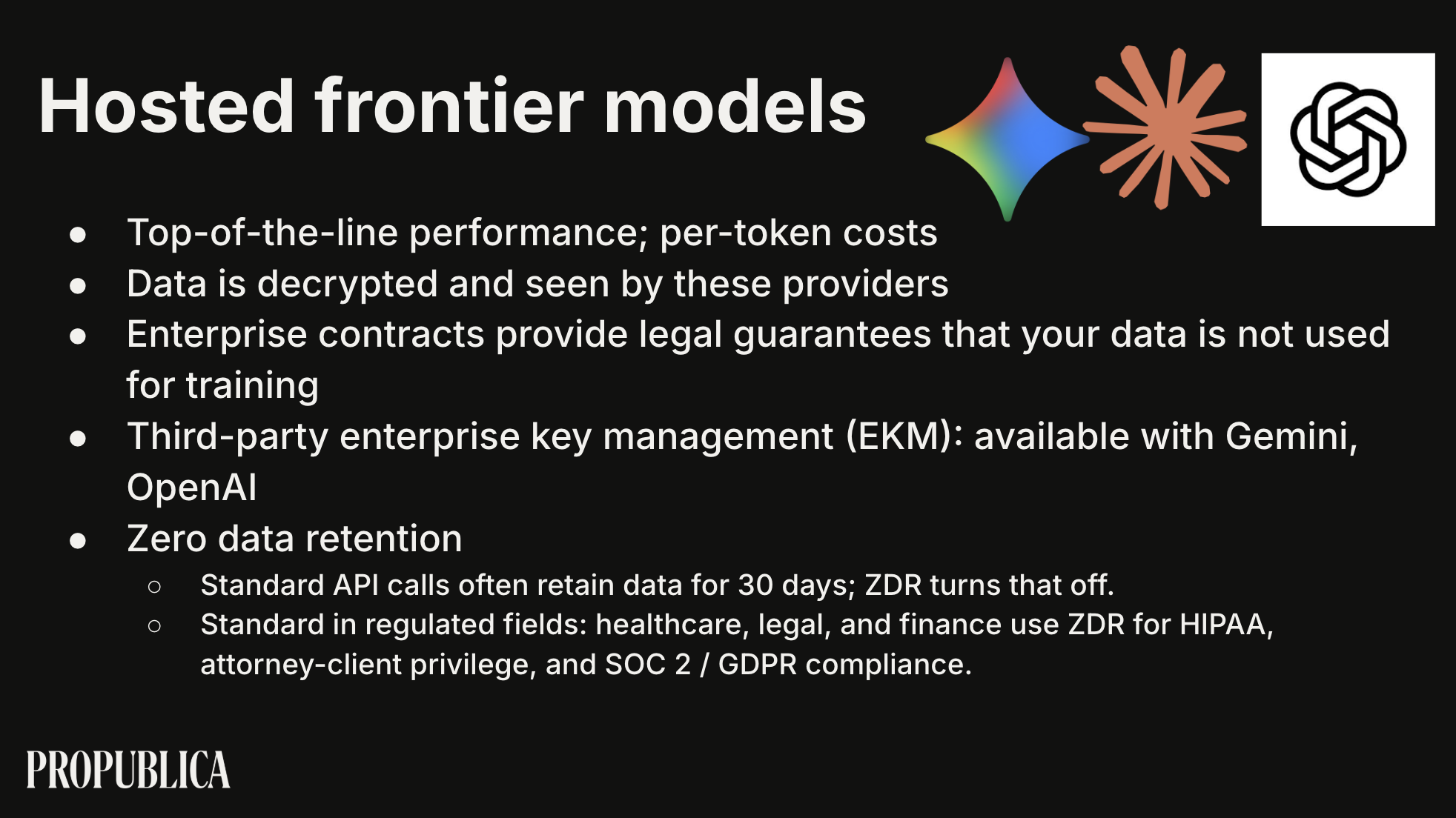

What’s Possible With Local Models? Building Secure AI Pipelines for Investigative Journalism

Ben Werdmuller & Dana Chiueh (ProPublica)

Paikallisesti pyörivät AI-mallit ratkaisevat yksityisyysongelman, mutta luovat uusia: mitkä mallit toimivat, mihin ne soveltuvat, mitä taitoja tarvitaan? ProPublican tiimi esitteli, miten he ovat rakentaneet turvallisia AI-putkistoja tutkivaan journalismiin paikallisilla malleilla.

Getting the Very, Very Best Out of Archival Audio

Mark Chonofsky (Chicago Public Media)

Chonofsky kertoi, miten he ovat litteroineet WBEZ:n koko äänarkiston tekoälyavusteisesti ja mitä teknisiä haasteita se vaati: äänen valmistelu, puhujien tunnistaminen, erikoistermit, vaihtelevat tallennusolosuhteet.

From Fear to Fluency: Building an AI-Ready Newsroom Culture

Peder Hammerskov (Center for AI at DMJX)

Hammerskov esitteli työtä, jota tanskalaisten uutistoimitusten kanssa on tehty AI-kulttuurin rakentamisessa.

Tunnelma: synkistelystä ei tietoakaan

Loppuun omia mietteitäni. Poikkeuksellisen Hacks and Hackers -tapahtumasta teki tunnelma. Synkistelyä ei ollut lainkaan. Huolipuheen puuttumisen panivat merkille myös tapahtuman järjestäjät loppupuheenvuorossaan: alan murros voidaan nähdä myös mahdollisuutena. Jotain kuvastanee myös tämä AI-kurssikaverini, uutistoimisto AP:n Head of Productin Bryan Davisin ilme=)

Vakavammin ottaen, kaksi havaintoa jäi erityisesti mieleen. Torstaiaamun ryhmäharjoituksessa asetuimme kaikki noin kolmesataa ihmistä isoon rinkiin, ja moni kertoi pyydettäessä avoimista tehtävistä organisaatioissaan. Käden sai nostaa pystyyn, jos koki että pystyy auttamaan joko itse tai vinkkaamaan sopivan rekryn. Virkistävää.

Toinen mieleen jäänyt ajatus on se, että eurooppalaista ja etenkin pohjoismaista tekoälytekemistä arvostetaan täälläkin laajalti. Mutta se täytyy tämän tapahtuman perusteella sanoa, että amerikkalaiset kirivät kovaa, etenkin uutishankinnan automatisoinnin saralla.

Järjestäjät alleviivasivat halunneensa pitää tapahtuman startup-henkisenä, mikä toteutuikin. Asian kääntöpuoli on se, että ensi vuonna tapahtumaan tuskin on saatavilla kovin paljon enemmän lippuja: kun juttelin pääjärjestäjän kanssa, hän totesi, että ei halua kasvattaa tapahtumaa kovin paljon isommaksi, koska tietynlainen ”kotikutoisuus” kärsisi.

Kiitokset Media-alan tutkimussäätiölle matka-apurahasta, jonka turvin tälle reissulle pääsin!

PS. Tapahtumalla oli käytössä MCP-yhteys tapahtumaohjelmaan ja jaettuihin muistiinpanoihin, mikä helpotti kovasti omienkin muistiinpanojen täydentämistä Claude Coden avustuksella. Tapahtuman hengessä tallensin kaikki omat muikkarini omaan Obsidian-holviini, joka on koneluettavaan md-tiedostomuotoon materiaaleja pakkaava ilmainen muistiinpano-ohjelma. Näin niiden hyödyntäminen aina jatkossa kaikissa Claude-keskusteluissani on helpompaa.